- Modelos autorregressivos de médias móveis

- Equações em diferenças

- Autocorrelação e autocorrelação parcial

- Previsão

- Estimação

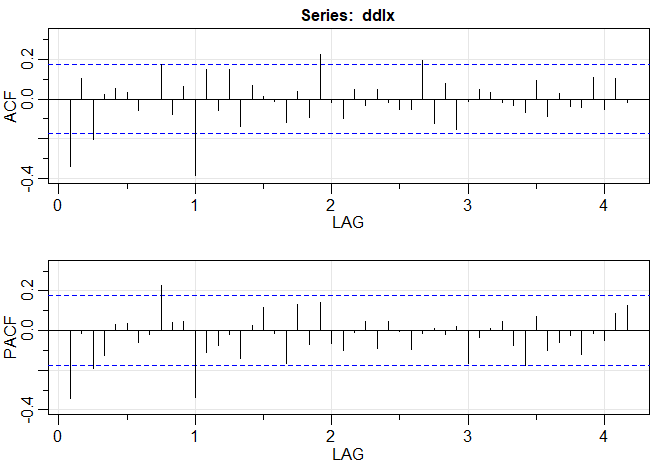

- Modelos integrados para dados não estacionários

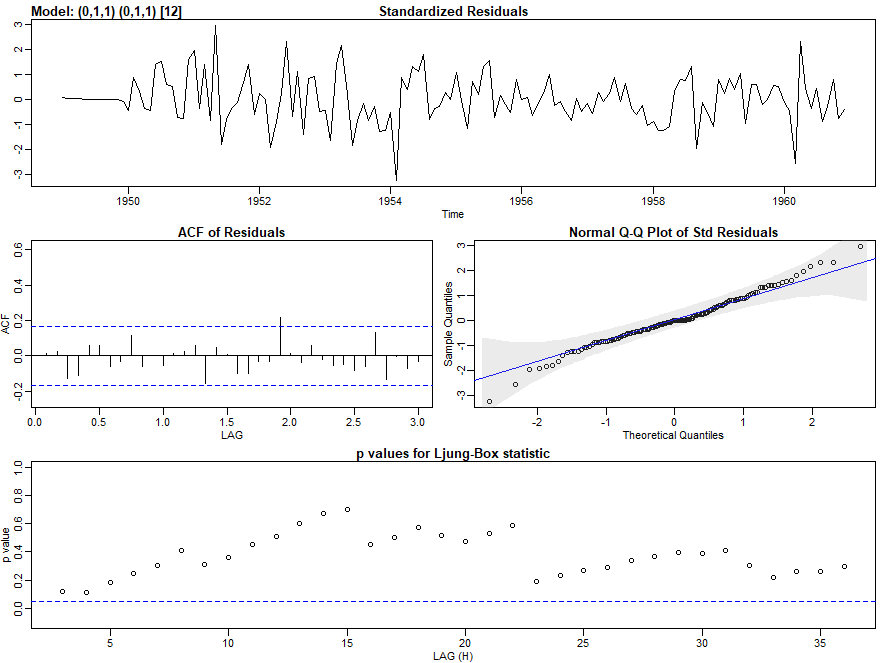

- Diagnóstico de resíduos para modelos ARIMA

- Regressão com erros autocorrelacionados

- Modelos ARIMA sazonais multiplicativos

- Exercícios

III.1 Modelos autorregressivos de médias móveis

O modelo de regressão clássico no Capítulo II foi desenvolvido para o caso estático, ou seja, apenas permitimos que a variável dependente seja influenciada pelos valores atuais das variáveis independentes. No caso de séries temporais, é desejável permitir que a variável dependente seja influenciada pelos valores passados das variáveis independentes e, possivelmente, pelos seus próprios valores passados. Se o presente puder ser modelado de maneira plausível em termos apenas dos valores passados dos insumos independentes, teremos a perspectiva sedutora de que a previsão será possível.

Introdução aos modelos autoregressivos

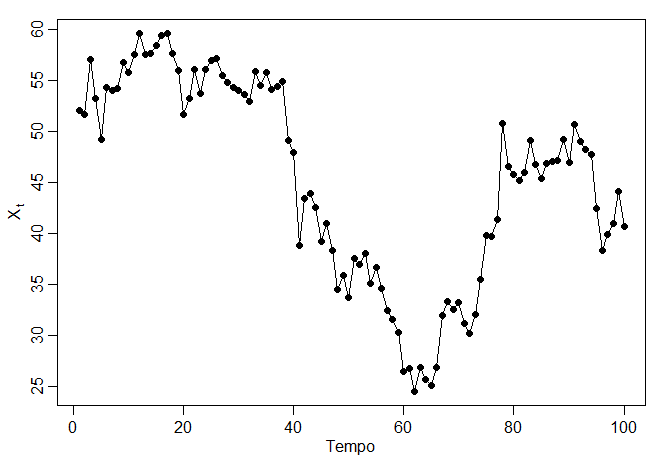

Os modelos autorregressivos baseiam-se na ideia de que o valor atual da série \(X_t\), pode ser explicado como uma função de \(p\) valores passados, \(X_{t-1},X_{t-2},\cdots,X_{t-p}\), onde \(p\) determina o número de etapas no passado necessárias para prever o valor atual. Como um caso típico, lembremos do Exemplo I.10, no qual os dados foram gerados usando o modelo \begin{equation} X_t=X_{t-1}-0.90 X_{t-2}+W_t, \end{equation} onde \(W_t\) é um ruído branco gaussiano com \(\sigma_{_W}^2=1\).

Agora assumimos que o valor atual é uma função linear particular de valores passados. A regularidade que persiste na figura do Exemplo I.9 dá uma indicação de que a previsão para tal modelo pode ser uma possibilidade distinta, digamos, através de alguma versão como \begin{equation} \widehat{X}_{n+1}^n = X_n - 0.90 X_{n-1}, \end{equation} onde a quantidade no lado esquerdo indica a previsão no próximo período \(n + 1\) com base nos dados observados, \(X_1,X_2,\cdots,X_n\). Vamos tornar essa noção mais precisa em nossa discussão sobre previsão.

A medida em que pode ser possível prever uma série de dados reais a partir de seus próprios valores passados pode ser avaliada examinando-se a função de autocorrelação e as matrizes do gráfico de dispersão discutidas na Parte II. Por exemplo, a matriz de dispersão defasada do Índice de Oscilação Meridional (SOI), mostrado na Figura II.8, fornece uma indicação distinta de que as defasagens 1 e 2, por exemplo, estão linearmente associadas ao valor atual. O ACF mostrado na Figura II.16 mostra valores positivos relativamente grandes nas defasagens 1, 2, 12, 24 e 36 e grandes valores negativos em 18, 30 e 42. Notamos também a possível relaç&ailde;o entre as séries de SOI e Recrutamento indicadas na matriz de dispersão mostrada na Figura II.9. Vamos indicar em seções posteriores sobre a função de transferência e modelagem do vetor AR como lidar com a dependência de valores obtidos por outras séries.

A discussão anterior motiva a seguinte definição.

Dizemos que \(\{X_t\}\) satisfaz um modelo autorregressivo de ordem \(p\) ou simplesmente \(AR(p)\) se \begin{equation} X_t=\phi_1 X_{t-1}+\phi_2 X_{t-2}+\cdots+\phi_p X_{t-p}+W_t, \end{equation} onde \(X_t\) é estacionário, \(W_t\sim N(0,\sigma_{_W}^2)\) é um ruído branco e \(\phi_1,\phi_2,\cdots,\phi_p\) são constantes tais que \(\phi_p\neq 0\).

A esperança de \(X_t\) satisfazendo um modelo autorregressivo é zero. Caso seja \(\mbox{E}(X_t)=\mu\neq 0\) podemos substituir \(X_t\) por \(X_t-\mu\) e temos \begin{equation} X_t-\mu=\phi_1 (X_{t-1}-\mu)+\phi_2 (X_{t-2}-\mu)+\cdots+\phi_p (X_{t-p}-\mu)+W_t \end{equation} ou escrevemos \begin{equation} X_t=\alpha + \phi_1 X_{t-1}+\phi_2 X_{t-2}+\cdots+\phi_p X_{t-p}+W_t, \end{equation} sendo \(\alpha=\mu(1-\phi_1-\phi_2-\cdots-\phi_p)\).

Notamos que o modelo acima é semelhante ao modelo de regressão da Seção II.1. Algumas dificuldades técnicas, entretanto, se desenvolvem na aplicação desse modelo porque os regressores \(X_{t-1},X_{t-2},\cdots,X_{t-p}\), são componentes aleatórios, enquanto \(Z_t\) foi considerado fixo. Uma forma útil segue usando o operador de retardo \(B\) para escrever o modelo \(AR(p)\) como \begin{equation} (1-\phi_1 B-\phi_2 B^2-\cdots-\phi_p B^p)X_t = W_t \end{equation} ou ainda de forma mais concisa como \(\phi(B)X_t=W_t\).

As propriedades de \(\phi(B)\) são importantes na resolução da equação acima para \(X_t\). Isso leva à seguinte definição.

Definimos o operador autorregressivo de ordem \(p\) como \begin{equation} \phi(B)=(1-\phi_1 B-\phi_2 B^2-\cdots-\phi_p B^p)\cdot \end{equation}

Exemplo III.1. Modelo \(AR(1)\).

Iniciamos a investigação de modelos de AR considerando o modelo de primeira ordem, \(AR(1)\), dado por \(X_t=\phi X_{t-1}+W_t\). Iterando para trás \(k\) vezes, conseguimos \begin{equation} \begin{array}{rcl} X_t & = & \phi X_{t-1} +W_t \, = \, \phi(\phi X_{t-2}+W_{t-1})+W_t \\ & = & \phi^2 X_{t-2}+\phi W_{t-1}+W_t \\ & = & \vdots \\ & = & \displaystyle \phi^k X_{t-k} + \sum_{j=0}^{k-1} \phi^j W_{t-j}\cdot \end{array} \end{equation}

Este método sugere que, continuando a iterar para trás e, desde que, \(|\phi|< 1\) e \(\sup_t \mbox{Var}(X_t)< \infty\), podemos representar o modelo \(AR(1)\) como um processo linear da forma \begin{equation} X_t \, = \, \sum_{j=0}^\infty \phi^j W_{t-j}\cdot \end{equation} Observe que \begin{equation} \lim_{k\to\infty} \mbox{E}\Big( X_t-\sum_{j=0}^{k-1}\phi^j W_{t-j}\Big)^2 \, = \, \lim_{k\to\infty} \phi^2\mbox{E}\big( X_{t-k}^2\big) \, = \, 0, \end{equation} de maneira que a expressão acima existe no sentido de média quadrádita, ver Anexo A para a definição.

A representação \(X_t \, = \, \sum_{j=0}^\infty \phi^j W_{t-j}\) é chamada de solução estacionária do modelo. De fato, por simples substituição, \begin{equation} \underbrace{\displaystyle\sum_{j=0}^\infty \phi^j W_{t-j}}_{X_t} \, = \, \phi \underbrace{\displaystyle\sum_{k=0}^\infty \phi^k W_{t-i-k}}_{X_{t-1}} \, + \, W_t\cdot \end{equation}

O modelo \(AR(1)\) definido acima é estacionário com média \begin{equation} \mbox{E}(X_t) \, = \, \sum_{j=0}^\infty \phi^j \mbox{E}(W_{t-j}) \, = \, 0 \end{equation} e função de autocovariância \begin{equation} \begin{array}{rcl} \gamma(h)& = & \mbox{Cov}(X_{t+h},X_t) \, = \, \displaystyle\mbox{E}\left( \Big(\sum_{j=0}^\infty \phi^j W_{t+h-j}\Big)\Big(\sum_{k=0}^\infty \phi^k W_{t-k}\Big)\right) \\ & = & \displaystyle\mbox{E}\left( \Big(W_{t+h}+\cdots+\phi^h W_t+\phi^{h+1} W_{t-1}+\cdots\Big)\Big(W_t+\phi W_{t-1}+\cdots\Big)\right) \\ & = & \displaystyle\sigma_{_W}^2\sum_{j=0}^\infty \phi^{h+j}\phi^j \, = \, \sigma_{_W}^2\phi^h\sum_{j=0}^\infty \phi^{2j} \, = \, \dfrac{\sigma_{_W}^2 \phi^h}{1-\phi^2}, \qquad h\geq 0\cdot \end{array} \end{equation}

Recordemos que \(\gamma(h)=\gamma(-h)\), então vamos exibir apenas a função de autocovariância para \(h\geq 0\). Assim, obtemos que o ACF de um modelo \(AR(1)\) é da forma \begin{equation} \rho(h) \, = \, \dfrac{\gamma(h)}{\gamma(0)} \, = \, \phi^h, \qquad h\geq 0, \end{equation} e \(\rho(h)\) satisfaz a recursão \begin{equation} \rho(h) \, = \, \phi \rho(h-1), \qquad h=1,2,\cdots \cdot \end{equation} Discutiremos o ACF de um modelo geral \(AR(p)\) na Seção III.3.

Exemplo III.2. O caminho da amostra de um processo \(AR(1)\).

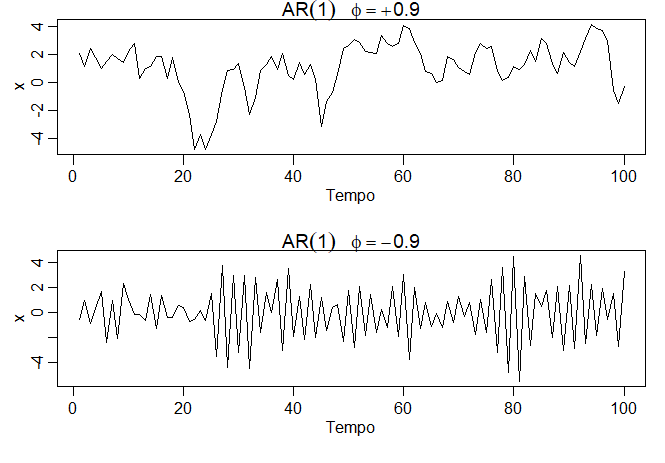

A figura abaixo mostra um gráfico no tempo de dois processos \(AR(1)\), um com \(\phi=0.9\) e um com \(\phi=-0.9\); em ambos os casos, \(\sigma_{_W}^2 = 1\). No primeiro caso, \(\rho(h)=0.9^h\), para \(h\geq 0\), então as observações próximas no tempo estão positivamente correlacionadas entre si. Esse resultado significa que as observações em pontos de tempo contíguos tenderão a estar próximas em valor umas às outras; este fato aparece no topo da figura abaixo como um caminho amostral muito suave para \(X_t\).

Agora, compare isso com o caso em que \(\phi=-0.9\), de modo que \(\rho(h)=(-0.9)^h\), para \(h\geq 0\). Esse resultado significa que as observações em pontos de tempo contíguos são negativamente correlacionadas, mas observações em dois pontos de tempo distintos estão positivamente correlacionados. Este fato aparece na parte inferior da figura abaixo, onde, por exemplo, se uma observação \(X_t\), é positiva, a próxima observação \(X_{t+1}\) é tipicamente negativa, e a próxima observação, \(X_{t+2}\) é tipicamente positiva. Assim, neste caso, o caminho da amostra é muito instável.

|

|---|

Exemplo III.3. Modelos AR Explosivos e Causalidade.

No Exemplo I.18, descobriu-se que a caminhada aleatória \(X_t = X_{t-1}+W_t\) não é estacionária. Podemos nos perguntar se existe um processo estacionário \(AR(1)\) com \(|\phi|> 1\). Tais processos são chamados de explosivos porque os valores da série temporal rapidamente se tornam grandes em magnitude. Claramente, porque \(|\phi|^j\) aumenta sem limite quando \(j\to\infty\), \(\sum_{j=0}^{k-1} \phi^j W_{t-j}\) não irá convergir em média quadrada quando \(k\to\infty\), então a intuição usada para obter que \( X_t \, = \, \sum_{j=0}^\infty \phi^j W_{t-j}\) não funcionará diretamente. Podemos, no entanto, modificar esse argumento para obter um modelo estacionário da seguinte forma. Escreva \(X_{t+1} = \phi X_t + W_{t+1}\), nesse caso, \begin{equation} \begin{array}{rcl} X_t & = & \displaystyle\frac{1}{\phi}X_{t+1} - \frac{1}{\phi}W_{t+1} \, = \, \frac{1}{\phi}\Big(\frac{1}{\phi}X_{t+2}-\frac{1}{\phi}W_{t+2} \Big) -\frac{1}{\phi}W_{t+1} \\ & \vdots & \vdots \\ & = & \displaystyle\frac{1}{\phi^k}X_{t+k} -\sum_{j=1}^{k-1} \frac{1}{\phi^j} W_{t+j}, \end{array} \end{equation} por iterar passos \(k\) para a frente. Porque \(|\phi|^{-1} <1\), este resultado sugere o modelo dependente estacionário futuro \(AR(1)\) \begin{equation} X_t \, = \, -\sum_{j=1}^\infty \frac{1}{\phi^j} W_{t+j}\cdot \end{equation}

O leitor pode verificar que este modelo é estacionário e da forma \(AR(1)\) com \(X_t = \phi X_{t-1}+W_t\). Infelizmente, esse modelo é inútil porque requer que saibamos o futuro para podermos prever o futuro. Quando um processo não depende do futuro, como o \(AR(1)\) quando \(|\phi| < 1\), diremos que o processo é causal. No caso explosivo deste exemplo, o processo é estacionário, mas também depende do futuro e não é causal.

Exemplo III.4. Toda explosão tem uma causa.

Excluir modelos explosivos da consideração não é um problema porque os modelos têm contrapartes causais. Por exemplo, se \begin{equation} X_t \, = \, \phi X_{t-1}+W_t, \qquad \mbox{com} \qquad |\phi|>1, \end{equation} e \(W_t\sim N(0,\sigma_{_W}^2)\), independentes igualmente distribuídos. Então utilizando o modelo \(X_t = -\sum_{j=1}^\infty \phi^{-j} W_{t+j}\) \(\{X_t\}\) é um processo Gaussiano estacionário não causal com \(\mbox{E}(X_t)=0\) e \begin{equation} \begin{array}{rcl} \gamma_{_X}(h) & = & \mbox{Cov}(X_{t+h},X_t) \, = \, \displaystyle\mbox{Cov}\left( -\sum_{j=1}^\infty \frac{1}{\phi}W_{t+h+j} -\sum_{k=1}^\infty \frac{1}{\phi^k}W_{t+k}\right) \\ & = & \dfrac{\sigma_{_W}^2}{\phi^2\phi^h(1-\phi^{-2})}\cdot \end{array} \end{equation}

Assim, o processo causal definido por \begin{equation} Y_t \, = \, \frac{1}{\phi}Y_{t-1}+V_t, \end{equation} onde \(V_t\sim N(0,\sigma_{_W}^2\phi^{-2})\) é estocasticamente igual ao processo \(X_t\), ou seja, todas as distribuições finitas dos processos são as mesmas. Por exemplo, se \(X_t = 2X_{t-1}+W_t\) com \(\sigma_{_W}^2=1\), então \(Y_t = \frac{1}{2}Y_{t-1}+V_t\) com \(\sigma_{_V}^2 = 1/4\) é um processo causal equivalente, ver o Exercício III.3. Este conceito generaliza para ordens superiores, mas é mais fácil de mostrar usando técnicas na Parte IV; veja o Exemplo IV.8.

A técnica de iterar para obter uma idéia da solução estacionária de modelos \(AR\) funciona bem quando \(p = 1\), mas não para ordens maiores. Uma técnica geral é a dos coeficientes correspondentes. Considere o modelo \(AR(1)\) na forma de operador \begin{equation} \phi(B)X_t \, = \, W_t, \end{equation} onde \(\phi(B)=1-\phi B\) e \(|\phi|< 1\). Também podemos escrever, utilizando o operador de forma \begin{equation} X_t \, = \, \sum_{j=0}^\infty \psi_j W_{t-j} \, = \, \psi(B)W_t, \end{equation} onde \(\psi(B)=\sum_{j=0}^\infty \psi_j B^j\) e \(\psi_j=\phi^j\). Suponha que não soubéssemos que \(\psi_j=\phi^j\). Substituindo, temos que \begin{equation} \phi(B)\psi(B)W_t \, = \, W_t\cdot \end{equation}

Os coeficientes de \(B\) no lado esquerdo e direito devem ser iguais, o que significa \begin{equation} (1-\phi B)\big( 1+\psi_1 B+\psi_2 B^2 + \cdots+\psi_j B^j+\cdots\big) \, = \, 1\cdot \end{equation} Reorganizando os coeficientes acima, temos \begin{equation} 1+(\psi_1-\phi)B+(\psi_2-\psi_1\phi)B^2+\cdots+(\psi_j-\psi_{j-1}\phi)B^j+\cdots \, = \, 1, \end{equation} vemos que para cada \(j = 1,2,\cdots\), o coeficiente de \(B^j\) à esquerda deve ser zero porque é zero à direita. O coeficiente de \(B\) à esquerda é de \(\psi_1-\phi\), e igualando isso a zero, \(\psi_1-\phi=0\), leva a \(\psi_1=\phi\). Continuando, o coeficiente de \(B^2\) é \(\psi_2-\psi_1\phi\), então \(\psi_2=\phi^2\). Em geral, \begin{equation} \psi_j=\psi_{j-1}\phi, \end{equation} com \(\psi_0=1\), o qual nos leve à solução \(\psi_j=\phi^j\).

Outra maneira de pensar sobre as operações que acabamos de realizar é considerar o modelo \(AR(1)\) na forma de operador, \(\phi(B)X_t = W_t\). Agora multiplique ambos os lados por \(\phi^{-1}(B)\), assumindo que o operador inverso exista, para obter \begin{equation} \phi^{-1}(B)\phi(B)X_t \, = \, \phi^{-1}(B)W_t, \end{equation} ou \begin{equation} X_t \, = \, \phi^{-1}(B)W_t\cdot \end{equation}

Nós já sabemos que \begin{equation} \phi^{-1}(B) \, = \, 1+\phi B+\phi^2 B^2 +\cdots+\phi^j B^j +\cdots, \end{equation} isto é, \(\phi^{-1}(B)=\psi(B)\) acima. Assim, notamos que trabalhar com operadores é como trabalhar com polinômios. Isto é, considere o polinômio \(\phi(z)=1-\phi z\), onde \(z\) é um número complexo e \(|\phi|< 1\). Então \begin{equation} \phi^{-1}(z) \, = \, \displaystyle\frac{1}{1-\phi z} \, = \, 1+\phi z+\phi^2 z^2+\cdots + \phi^j z^j +\cdots, \qquad |z|\leq 1, \end{equation} e os coeficientes de \(B^j\) em \(\phi^{-1}(B)\) são os mesmos que os coeficientes de \(z^j\) em \(\phi^{-1}(z)\). Em outras palavras, podemos tratar o operador de retrocesso \(B\), como um número complexo \(z\). Esses resultados serão generalizados em nossa discussão sobre os modelos ARMA. Os polinômios correspondentes aos operadores serão úteis para explorar as propriedades gerais dos modelos ARMA.

Introdução aos modelos de médias móveis

Como uma alternativa à representação autorregressiva na qual os \(X_t\) no lado esquerdo da equação são combinados linearmente, o modelo de médias móveis de ordem \(q\), abreviado como \(MA(q)\), assume o ruído branco \(W_t\) do lado direito da equação definidora seja combinado linearmente para formar os dados observados.

O modelo de médias móveis de ordem \(q\) ou \(MA(q)\) é definido como \begin{equation} X_t \, = \, W_t + \theta_1 W_{t-1}+\theta_2 W_{t-2}+\cdots+\theta_q W_{t-q}, \end{equation} onde \(W_t\sim N(0,\sigma_{_W}^2)\) independentes e \(\theta_1,\theta_2,\cdots,\theta_q\), \(\theta_q\neq 0\) são parâmetros.

Em alguns textos e pacotes define-se o modelo \(MA(q)\) com coeficientes negativos; isso é, \begin{equation} X_t \, = \, W_t - \theta_1 W_{t-1}-\theta_2 W_{t-2}-\cdots-\theta_q W_{t-q}\cdot \end{equation}

O sistema é o mesmo que o da média móvel infinita definida como o processo linear \begin{equation*} X_t \, = \, \sum_{j=0}^\infty \psi_j W_{t-j} \, = \, \psi(B)W_t, \end{equation*} onde \(\psi_0 = 1\), \(\psi_j = \theta_j\), para \(j = 1,\cdots,q\) e \(\psi_j = 0\) para outros valores. Podemos também escrever o processo \(MA(q)\) na forma equivalente \begin{equation} X_t \, = \, \theta(B)W_t, \end{equation} utilizando a seguinte definição.

O operador de médias móveis é definido como \begin{equation} \theta(B) \, = \, 1+\theta_1 B+\theta_2 B^2 + \cdots + \theta_q B^q\cdot \end{equation}

Ao contrário do processo autoregressivo, o processo de médias móveis é estacionário para quaisquer valores dos parâmetros \(\theta_1,\cdots,\theta_q\); detalhes desse resultado são fornecidos na Seção III.3.

Exemplo III.5. O processo \(MA(1)\).

Consideremos o modelo \(MA(1)\) \(X_t=W_t+\theta W_{t-1}\). Então \(\mbox{E}(X_t)=0\), \begin{equation} \gamma(h) \, = \, \left\{\begin{array}{ccl} (1+\theta^2)\sigma_{_W}^2, & \mbox{quando} & h=0 \\ \theta\sigma_{_W}^2, & \mbox{quando} & h=1 \\ 0, & \mbox{quando} & h>1 \end{array}\right., \end{equation} e o ACF é \begin{equation} \rho(h) \, = \, \left\{\begin{array}{ccl} \displaystyle\frac{\theta}{1+\theta^2}, & \mbox{quando} & h=1 \\ 0, & \mbox{quando} & h>1 \end{array}\right.\cdot \end{equation}

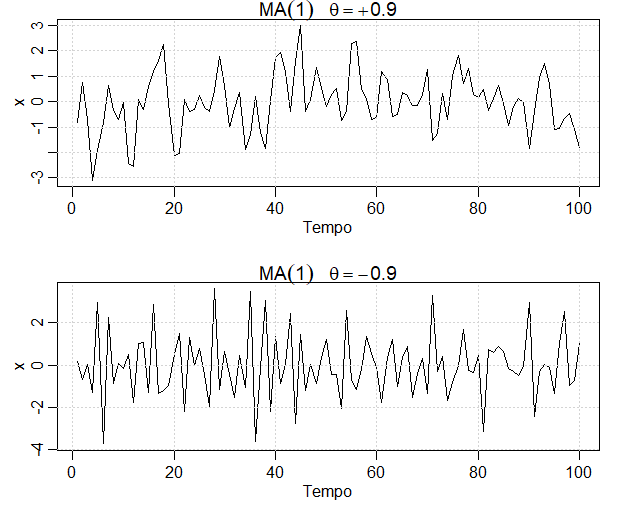

Observemos que \(|\rho(1)|\leq 1/2\) para todos os valores de \(\theta\). Além disso, \(X_t\) está correlacionado com \(X_{t-1}\), mas não com \(X_{t-2},X_{t-3},\cdots\). Compare isso com o caso do modelo \(AR(1)\) no qual a correlação entre \(X_t\) e \(X_{t-k}\) nunca é zero. Quando \(\theta=0.9\), por exemplo, \(X_t\) e \(X_{t-1}\) estão positivamente correlacionados e \(\rho(1)=0.497\). Quando \(\theta=-0.9\), \(X_t\) e \(X_{t-1}\) são correlacionados negativamente e \(\rho(1)=-0.497\). A figura abaixo mostra um gráfico de tempo destes dois processos com \(\sigma_{_W}^2 = 1\). Perceba que a série para qual \(\theta=0.9\) é mais suave que a série para a qual \(\theta=-0.9\).

|

|---|

Exemplo III.6. Não unicidade dos modelos MA e da invertibilidade.

Usando o Exemplo III.5, notamos que para um modelo \(MA(1)\), \(\rho(h)\) é o mesmo para \(\theta\) e \(1/\theta\); tente 5 e 15, por exemplo. Além disso, o par \(\sigma_{_W}^2=1\) e \(\theta = 5\) produzem a mesma função de autocovariância que o par \(\sigma_{_W}^2 = 25\) e \(\theta= 1/5\), \begin{equation} \gamma(h) \, = \, \left\{ \begin{array}{ccl} 26, & \mbox{para} & h=0, \\ 5, & \mbox{pata} & h=1, \\ 0, & \mbox{para} & h>1\cdot \end{array}\right.\cdot \end{equation}

Portanto, o processo \(MA(1)\) \begin{equation} X_t \, = \, W_t+\frac{1}{5}W_{t-1}, \qquad W_t\sim N(0,25) \end{equation} independentes e \begin{equation} Y_t \, = \, V_t+5V_{t-1}, \qquad V_t\sim N(0,1), \end{equation} independentes são os mesmos por causa da normalidade, ou seja, todas as distribuições finitas são as mesmas. Somente podemos observar as séries temporais, \(X_t\) ou \(Y_t\), e não o ruído, \(W_t\) ou \(V_t\), então não podemos distinguir entre os modelos. Por isso, teremos que escolher apenas um deles. Por conveniência, imitando o critério de causalidade para modelos de AR, escolheremos o modelo com uma representação AR infinita. Tal processo é chamado de processo inversível.

Para descobrir qual modelo é invertível, podemos inverter os papéis de \(X_t\) e \(W_t\), isso porque estamos imitando o caso \(AR\) e escrever o modelo \(MA(1)\) como \(W_t = -\theta W_{t-1}+X_t\).

Se \(|\theta|< 1\), então \(W_t = \sum_{j=0}^\infty (-\theta)^j X_{t-j}\), que é a representação \(AR\) infinita desejada do modelo. Assim, dada uma escolha, escolheremos o modelo com \(\sigma_{_W}^2= 25\) e \(\theta= 1/5\) porque é invertível.

No caso AR, o polinômio, \(\theta(z)\) correspondente aos operadores de médias móveis, \(\theta(B)\) será útil na exploração das propriedades gerais dos processos de MA. Por exemplo, podemos escrever o modelo \(MA(1)\) como \(X_t = \theta(B)W_t\), onde \(\theta(B) = 1 + \theta B\). Se \(|\theta|< 1\), então podemos escrever o modelo como \(\pi(B) X_t = W_t\), onde \(\pi(B)=\theta^{-1}(B)\).

Seja \(\theta(z)=1 + \theta z\), para \(|z|\leq 1\), então \begin{equation} \pi(z) \, = \,\theta^{-1}(z)=\dfrac{1}{1+\theta z}=\sum_{j=0}^\infty (-\theta)^j z^j \end{equation} e determinamos que \(\pi(B)=\sum_{j=0}^\infty (-\theta)^j B^j\).

Modelos autorregressivos de médias móveis

Prosseguimos agora com o desenvolvimento do modelo geral de médias móveis autoregressivos e o modelo de médias móveis autorregressivos mistos (ARMA), modelos para séries temporais estacionárias.

A série temporal \(\{X_t \, : \, t=0,\pm 1,\pm 2,\cdots\}\) é \(ARMA(p,q)\) se é estacionária e \begin{equation} X_t \, = \, \phi_1 X_{t-1}+\cdots+\phi_p X_{t-p}+W_t+\theta_1 W_{t-1}+\cdots+\theta_q W_{t-q}, \end{equation} onde \(\phi_p\neq 0\), \(\theta_q\neq 0\) e \(\sigma_{_W}^2>0\). Os parâmetros \(p\) e \(q\) são chamados ordens autorregressivas e de médias móveis, respectivamente. Se \(X_t\) tiver uma média \(\mu\) diferente de zero, definimos \(\alpha=\mu(1-\phi_1-\cdots-\phi_p)\) e escrevemos o modelo como \begin{equation} X_t \, = \, \alpha+\phi_1 X_{t-1}+\cdots+\phi_p X_{t-p}+W_t+\theta_1 W_{t-1}+\cdots+\theta_q W_{t-q}, \end{equation} onde \(W_t\sim N(0,\sigma_{_W}^2)\) independentes.

Como observado anteriormente, quando \(q = 0\), o modelo é chamado de modelo autorregressivo de ordem \(p\) ou \(AR(p)\), e quando \(p = 0\), o modelo é chamado de modelo de médias móveis de ordem \(q\) ou \(MA(q)\). Para auxiliar na investigação de modelos ARMA, será útil escrevê-los usando o operador AR e o operador MA. Em particular, o modelo \(ARMA(p,q)\) pode então ser escrito de forma concisa \begin{equation} \phi(B)X_t \, = \, \theta(B)W_t\cdot \end{equation}

A forma concisa do modelo aponta para um problema potencial em que podemos complicar desnecessariamente o modelo multiplicando ambos os lados por outro operador, digamos \begin{equation} \eta(B)\phi(B)X_t \, = \, \eta(B)\theta(B)W_t, \end{equation} sem mudar a dinâmica. Considere o seguinte exemplo.

Exemplo III.7. Redundância de parâmetros.

Considere o processo de ruído branco \(X_t=W_t\). Multiplicando ambos os lados pela equação \(\eta(B)=1-0.5 B\), então o modelo torna-se \((1-0.5 B)X_t=(1-0.5 B)W_t\) ou \begin{equation} X_t \, = \, 0.5 X_{t-1}-0.5 W_{t-1}+W_t, \end{equation} que se parece com um modelo \(ARMA(1,1)\). Claro, \(X_t\) ainda é ruído branco; nada mudou a esse respeito, ou seja, \(X_t = W_t\) é a solução para o modelo acima, mas ocultamos o fato de que \(X_t\) é ruído branco por causa da redundância de parâmetros ou parametrização excessiva.

A consideração da redundância de parâmetros será crucial quando discutirmos a estimativa para modelos gerais ARMA. Como este exemplo aponta, podemos ajustar um modelo \(ARMA(1,1)\) para dados de ruído branco e descobrir que as estimativas dos parâmetros são significativos. Se não estivéssemos cientes da redundância de parâmetros, poderíamos afirmar que os dados estão correlacionados quando na verdade não são. Embora ainda não tenhamos discutido a estimação, apresentamos a seguinte demonstração do problema. Geramos 150 amostras normais independentes identicamente distribuídas e depois ajustamos um \(ARMA(1,1)\) aos dados. Note que \(\widehat{\phi}=-0.96\) e \(\widehat{\theta}=0.95\) e ambos são significativos.

Abaixo está o código R , note que a estimativa chamada intercept é realmente a estimativa da média.Assim, esquecendo a estimativa da média, o modelo ajustado parece \begin{equation} (1+0.96B)X_t \, = \, (1+0.96B)W_t, \end{equation} que devemos reconhecer como um modelo super-parametrizado.

Os exemplos III.3, III.6 e III.7 apontam para um número de problemas possíveis com a definição geral de modelos \(ARMA(p,q)\). Para resumir, vimos os seguintes problemas:

- (a) modelos redundantes de parâmetros,

- (b) modelos estacionários AR que dependem do futuro e

- (c) modelos MA que não são exclusivos.

Para superar esses problemas, vamos exigir algumas restrições adicionais nos parâmetros do modelo. Primeiro, fazemos as seguintes definições.

Os polinômios AR e MA são definidos como \begin{equation} \phi(z) \, = \, 1-\phi_1 z-\cdots -\phi_p z^p, \qquad \phi_p\neq 0, \end{equation} e \begin{equation} \theta(z) \, = \, 1+\theta_1 z+\cdots +\theta_q z^q, \qquad \theta_q\neq 0, \end{equation} respectivamente, onde \(z\) é um número complexo.

Para resolver o primeiro problema, iremos nos referir a um modelo \(ARMA(p,q)\) para significar que ele está em sua forma mais simples. Ou seja, além da definição original também exigiremos que \(\phi(z)\) e \(\theta(z)\) não tenham fatores comuns. Assim, o processo, \(X_t = 0.5 X_{t-1}-0.5 W_{t-1}+W_t\), discutido no Exemplo III.7 não é referido como um processo \(ARMA(1,1)\) porque, em sua forma reduzida, \(X_t\) é ruído branco.

Para abordar o problema dos modelos dependentes do futuro, introduzimos formalmente o conceito de causalidade.

Um modelo \(ARMA(p,q)\) é considerado causal, se a série temporal \(\{X_t \, : \, t = 0,\pm 1,\pm 2,\cdots\}\) pode ser escrito como um processo linear unilateral: \begin{equation} X_t \, = \, \sum_{j=0}^\infty \psi_j W_{t-j} \, = \, \psi(B) W_t, \end{equation} onde \(\psi(B)=\sum_{j=0}^\infty \psi_j B^j\) e \(\sum_{j=0}^\infty |\psi_j|< \infty\), escolhemos \(\psi_0=1\).

No Exemplo III.3, o processo \(AR(1)\), \(X_t = \phi X_{t-1}+W_t\) é causal apenas quando \(|\phi|< 1\). Equivalentemente, o processo é causal apenas quando a raiz de \(\phi(z)=1-\phi z\) é maior que um em valor absoluto. Ou seja, a raiz \(z_0\) de \(\phi(z)\) é \(z_0 = 1/\phi\), porque \(\phi(z_0) = 0\) e \(|z_0|> 1\) porque \(|\phi|< 1\). Em geral, temos a seguinte propriedade.

Um modelo \(ARMA(p,q)\) é causal se, e somente se, \(\phi(z)\neq 0\) para \(|z|\leq 1\). Os coeficientes do processo linear na Definição III.7 podem ser determinados resolvendo-se \begin{equation} \psi(z) \, = \, \displaystyle\sum_{j=0}^\infty \psi_j z^j \, = \, \dfrac{\theta(z)}{\phi(z)}, \qquad |z|\leq 1\cdot \end{equation}

Outra maneira de expressar o Teorema III.1 é que um processo ARMA é causal apenas quando as raízes de \(\phi(z)\) estão fora do círculo unitário; isto é, \(\phi(z)=0\) somente quando \(|z|>1\). Finalmente, para resolver o problema de unicidade discutido no Exemplo III.6, escolhemos o modelo que permite uma representação autorregressiva infinita.

Um modelo \(ARMA(p,q)\) é dito invertível se a série temporal \(\{X_t \, : \, t=0,\pm 1,\pm 2,\cdots\}\) pode ser escrita como \begin{equation} \pi(B)X_t \, = \, \sum_{j=0}^\infty \pi_j X_{t-j} \, = \, W_t, \end{equation} onde \(\pi(B)=\sum_{j=0}^\infty \pi_j B^j\) e \(\sum_{j=0}^\infty |\pi_j|< \infty\), escolhemos \(\pi_0=1\).

Analogamente ao Teorema III.1, temos a seguinte propriedade.

Um modelo \(ARMA(p,q)\) é invertível se, e somente se, \(\theta(z)\neq 0\) para \(|z|\leq 1\). Os coeficientes \(\pi_j\) de \(\pi(B)\) dados na Definição III.8 podem ser determinados resolvendo-se \begin{equation} \pi(z) \, = \, \displaystyle\sum_{j=0}^\infty \pi_j z^j \, = \, \dfrac{\phi(z)}{\theta(z)}, \qquad |z|\leq 1\cdot \end{equation}

Outra maneira de expressar o Teorema III.2 é que um processo ARMA é invertível somente quando as raízes de \(\theta(z)\) estão fora do círculo unitário; isto é, \(\theta(z)=0\) somente quando \(|z|> 1\).

Os exemplos a seguir ilustram esses conceitos.

Exemplo III.8. Redundância de parâmetros, causalidade, invertibilidade.

Considere o processo \begin{equation} X_t \, = \, 0.4 X_{t-1}+0.45 X_{t-2}+W_t+W_{t-1}+0.25 W_{t-2}, \end{equation} ou, na forma de operador \begin{equation} (1-0.4B-0.45B^2)X_t \, = \, (1+B+0.25B^2)W_t \cdot \end{equation}

Primeiramente, \(X_t\) parece ser um processo \(ARMA(2,2)\). Mas observe que \begin{equation} \phi(B) \, = \, 1-0.4B-0.45B^2 \, = \, (1+0.5B)(1-0.9B) \end{equation} e \begin{equation} \theta(B) \, = \, (1+B+0.25B^2) \, = \, (1+0.5B)^2, \end{equation} tem um fator comum que pode ser cancelado.

Após o cancelamento, os operadores são \(\phi(B)=(1-0.9B)\) e \(\theta(B)=(1+0.5B)\), portanto o modelo é um \(ARMA(1,1)\), \((1-0.9B)X_t = (1+0.5B)W_t\) ou \begin{equation} X_t \, = \, 0.9X_{t-1}+0.5W_{t-1}+W_t\cdot \end{equation}

O modelo é causal porque \(\phi(z)=(1-0.9z) = 0\) quando \(z = 10/9\), que está fora do círculo unitário. O modelo também é invertível porque a raiz de \(\theta(z)=(1+0.5z)\) é \(z = -2\); que está fora do círculo unitário.

Para escrever o modelo como um processo linear, podemos obter os pesos \(\psi\) usando o enunciado no Teorema III.1, \(\phi(z)\psi(z)=\theta(z)\), ou \begin{equation} (1-0.9z)(1+\psi_1 z+\psi_2 z^2+\cdots+\psi_j z^j +\cdots) \, = \, 1+0.5z\cdot \end{equation}

Reorganizando, ficamos \begin{equation} 1+(\psi_1-0.9)z+(\psi_2-0.9\psi_1)z^2+\cdots+(\psi_j-0.9\psi_{j-1})z^j+\cdots \, = \, 1+0.5z\cdot \end{equation}

Combinando os coeficientes de \(z\) nos lados esquerdo e direito, obtemos \(\psi_1-0.9=0.5\) e \(\psi_j-0.9\psi_{t-1}=0\) para \(j>1\). Portanto, \(\psi_j=1.4(0.9)^{j-1}\) para \(j\geq 1\) e podemos escrever \begin{equation} X_t \, = \, W_t+1.4 \sum_{j=1}^\infty 0.9^{j-1}W_{t-j}\cdot \end{equation}

Os valores de \(\psi_j\) podem ser calculados em R da seguinte forma:

A representação invertível usando o Teorema III.1 é obtida através da correspondência dos coeficientes em \(\theta(z)\pi(z)=\phi(z)\), \begin{equation} (1+0.5z)(1+\pi_1 z+\pi_2 z^2+\pi_3 z^3+\cdots) \, = \, 1-09.z\cdot \end{equation} Neste caso, os \(\pi\)-pesos são dados por \(\pi_j = (-1)^j1.4(0.5)^{j-1}\), para \(j\geq 1\) e daí, porque \(W_t=\sum_{j=0}^\infty \pi_j X_{t-j}\), também podemos escrever \begin{equation} X_t \, = \, 1.4\sum_{j=1}^\infty (-0.5)^{j-1}X_{t-j}+W_t\cdot \end{equation}

Os valores dos \(\pi_j\) podem ser calculados em R como segue, revertendo os papéis de \(W_t\) e \(X_t\), ou seja, escrevendo o modelo como \(W_t=-0.5W_{t-1}+X_t-0.9X_{t-1}\):

Exemplo III.9. Condições causais para o processo \(AR(2)\).

Para o modelo \(AR(1)\), \((1-\phi B)X_t=W_t\), ser causal, a raiz de \(\phi(z)=1-\phi z\) deve ficar fora do círculo unitário. Nesse caso, \(\phi(z)=0\) quando \(z=1/\phi\), por isso é fácil ir a partir do requisito causal na raiz, \(|1/\phi|> 1\), a um requisito no parâmetro, \(|\phi|< 1\). Não é tão fácil estabelecer essa relação para modelos de ordem superior.

Por exemplo, o modelo \(AR(2)\), é causal quando as duas raízes de \(\phi(z)=1-\phi_1 z-\phi_2 z^2\) ficam fora do círculo unitário. Usando a fórmula quadrática, este requisito pode ser escrito como \begin{equation} \left| \frac{\phi_1\pm \sqrt{\phi_1^2+4\phi_2}}{-2\phi_2}\right|> 1\cdot \end{equation}

As raizes de \(\phi(z)\) podem ser reais e distintas, reais e iguais ou um par conjugado complexo. Se denotarmos essas raízes por \(z_1\) e \(z_2\), podemos escrever \(\phi(z)=(1-z_1^{-1}z)(1-z_2^{-1}z)\), observe que \(\phi(z_1)=\phi(z_2)=0\).

O modelo pode ser escrito em forma de operador como \((1-z_1^{-1}B)(1-z_2^{-1}B)X_t=W_t\). A partir dessa representação, segue-se que \(\phi_1=(z_1^{-1}+z_2^{-1})\) e \(\phi_2=-(z_1 z_2)^{-1}\). Essa relação e o fato de que \(|z_1|> 1\) e \(|z_2|> 1\) podem ser usados para estabelecer a seguinte condição equivalente para causalidade: \begin{equation} \phi_1+\phi_2< 1, \qquad \phi_2-\phi_1< 1 \qquad \mbox{e} \qquad |\phi_2|< 1\cdot \end{equation} Essa condição de causalidade especifica uma região triangular no espaço paramétrico.

III.2 Equações em diferenças

O estudo do comportamento dos processos ARMA e seus ACFs é bastante aprimorado por um conhecimento básico de equações de diferenças, simplesmente porque são equações de diferença. Vamos dar um breve e heurístico relato do tópico, juntamente com alguns exemplos da utilidade da teoria. Para detalhes, o leitor é referido a Mickens (1990).

Suponhamos que a sequência de números \(u_0,u_1,u_2,\cdots\) sejam tais que \begin{equation} u_n-\alpha u_{n-1} \, = \, 0, \qquad \alpha\neq 0, \qquad n=1,2,\cdots\cdot \end{equation} Por exemplo, recordemos que a função ACF de um processo \(AR(1)\) é uma sequência \(\rho(h)\) satisfazendo \begin{equation} \rho(h)-\phi\rho(h-1)=0, \qquad h=1,2,\cdots\cdot \end{equation} A equação \(u_n-\alpha u_{n-1} \, = \, 0, \, \alpha\neq 0, \, n=1,2,\cdots\) representa uma equação de diferença homogênea de ordem 1. Para resolver a equação, escrevemos: \begin{equation} \begin{array}{rcl} u_1 & = & \alpha u_0 \\ u_2 & = & \alpha u_1 \, = \, \alpha^2 u_0 \\ \cdots & & \cdots \\ u_n & = & \alpha u_{n-1} \, = \, \alpha^n u_0\cdot \end{array} \end{equation} Dada uma condição inicial \(u_0 = c\), podemos resolver estas equações, ou seja, \(u_n = \alpha^n c\).

Na notação do operador, podemos escrever como \((1-\alpha B)u_n=0\). O polinômio associado é \(\alpha(z)=1-\alpha z\) e a raíz, digamos \(z_0\) deste polinômio é \(z_0=1/\alpha\), isto é \(\alpha(z_0)=0\). Sabemos que a solução, com a condição inicial \(u_0=c\), é \begin{equation} u_n \, = \, \alpha^n c \, = \, \dfrac{c}{z_0^n}\cdot \end{equation} Ou seja, a solução para a equação de diferença depende apenas da condição inicial e do inverso da raiz para o polinômio associado \(\alpha(z)\).

Agora suponha que a sequência satisfaça \begin{equation} u_n-\alpha_1 u_{n-1} -\alpha_2 u_{n-2} \, = \, 0, \qquad \alpha_2 \neq 0, \qquad n=2,3,\cdots\cdot \end{equation} Esta equação é uma equação de diferença homogênea de ordem 2. O polinômio correspondente é \begin{equation} \alpha(z) \, = \, 1-\alpha_1 z -\alpha_2 z^2, \end{equation} que tem duas raízes \(z_1\) e \(z_2\); isto é, \(\alpha(z_1)=\alpha(z_2)=0\). Vamos considerar dois casos. Primeiro suponha \(z_1\neq z_2\). Então a solução geral é \begin{equation} u_n \, = \, \dfrac{c_1}{z_1^n}+\dfrac{c_2}{z_2^n}, \end{equation} onde \(c_1\) e \(c_2\) dependem das condições iniciais. A alegação de que é uma solução pode ser verificada por substituição direta: \begin{array}{l} \underbrace{c_1z_1^{-n}+c_2z_2^{-n}}_{u_n}-\alpha_1\underbrace{\big(c_1z_1^{-(n-1)}+c_2z_2^{-(n-1)}\big)}_{u_{n-1}} -\alpha_2\underbrace{\big(c_1z_1^{-(n-2)}+c_2z_2^{-(n-2)}\big)}_{u_{n-2}} \, = \\ \qquad \qquad \qquad \qquad \qquad \qquad = \, c_1z_1^{-n}\big( 1-\alpha_1z_1-\alpha_2z_1^{2}\big)+c_2z_2^{-n}\big(1-\alpha_1z_2-\alpha_2z_2^2 \big) \\ \qquad \qquad \qquad \qquad \qquad \qquad = \, c_1z_1^{-n}\alpha(z_1)+c_2z_2^{-n}\alpha(z_2) \, = \, 0\cdot \end{array}

Dadas duas condições iniciais \(u_0\) e \(u_1\), podemos resolver para \(c_1\) e \(c_2\): \begin{equation} u_0 = c_1+c_2 \qquad \mbox{e} \qquad u_1 = c_1z_1^{-1}+c_2z_2^{-1}, \end{equation} onde \(z_1\) e \(z_2\) pode ser resolvido em termos de \(\alpha_1\) e \(\alpha_2\) usando a fórmula quadrática, por exemplo.

Quando as raízes são iguais, \(z_1=z_2=z_0\), uma solução geral é \begin{equation} u_n=\frac{c_1+c_2 n}{z_0^n}\cdot \end{equation} Esta alegação também pode ser verificada por substituição direta: \begin{array}{l} \underbrace{z_0^{-n}(c_1+c_2 n)}_{u_n}-\alpha_1\underbrace{\Big(z_0^{-(n-1)}\big(c_1+c_2(n-1)\big) \Big)}_{u_{n-1}} -\alpha_2\underbrace{\Big(z_0^{-{n-2}}\big(c_1+c_2(n-2) \big)\Big)}_{u_{n-2}} \, = \\ \qquad \qquad \qquad \qquad \qquad \qquad = \, z_0^{-n}(c_1+c_2 n)\big(1-\alpha_1z_0-\alpha_2z_0^2 \big) +c_2z_0^{-n+1}(\alpha_1+2\alpha_2z_0) \\ \qquad \qquad \qquad \qquad \qquad \qquad = \, c_2z_0^{-n+1}(\alpha_1+2\alpha_2z_0)\cdot \end{array}

Para mostrar que \(\alpha_1+2\alpha_2z_0=0\), escrevemos \(1-\alpha_1z-\alpha_2z^2=(1-z_0^{-1}z)^2\) e tomando derivados em relação a \(z\) em ambos os lados da equação para obter \(\alpha_1+2\alpha_2z=2z_0^{-1}(1-z_0^{-1}z)\). Portanto, \(\alpha_1+2\alpha_2z_0=2z_0^{-1}(1-z_0^{-1}z_0)\), como queriamos demonstrar. Finalmente, dadas duas condições iniciais \(u_0\) e \(u_1\), podemos resolver para \(c_1\) e \(c_2\): \begin{equation} u_0 \, = \, c_1 \qquad \mbox{e} \qquad u_1 \, = \, \frac{c_1+c_2}{z_0}\cdot \end{equation} Também pode ser mostrado que essas soluções são únicas.

Para resumir estes resultados, no caso de raízes distintas, a solução para a equação em diferenças homogênea de grau dois é \begin{array}{rcl} u_n & = & \dfrac{1}{z_1^n}\times (\mbox{um polinômio em } n \, \mbox{de grau} \, m_1-1)+\displaystyle \frac{1}{z_2^n}\times (\mbox{um polinômio em } n \, \mbox{de grau} \, m_2-1), \end{array} onde \(m_1\) é a multiplicidade da raiz \(z_1\) e \(m_2\) é a multiplicidade da raiz \(z_2\). Neste exemplo, é claro, \(m_1 = m_2 = 1\), e chamamos os polinômios de grau zero \(c_1\) e \(c_2\), respectivamente. No caso da raiz repetida, a solução foi \begin{equation} u_n \, = \, \frac{1}{z_0^n}\times (\mbox{um polinômio em } n \, \mbox{de grau} \, m_0-1), \end{equation} onde \(m_0\) é a multiplicidade da raiz \(z_0\), isto é, \(m_0 = 2\). Neste caso, escrevemos o polinômio de grau um como \(c_1 + c_2n\). Em ambos os casos, resolvemos para \(c_1\) e \(c_2\) dadas duas condições iniciais, \(u_0\) e \(u_1\).

Estes resultados generalizam para a equação em diferença homogênea de ordem \(p\): \begin{equation} u_n-\alpha_1 u_{n-1}-\cdots-\alpha_p u_{n-p} \, = \, 0, \qquad \alpha_p\neq 0, \qquad n=p,p+1,\cdots \cdot \end{equation} O polinômio associado é \(\alpha(z)=1-\alpha_1 z-\cdots-\alpha_p z^p\). Suponha que \(\alpha(z)\) tem raízes distintas, \(z_1\) com multiplicidade \(m_1\), \(z_2\) com multiplicidade \(m_2\), \(\cdots\) e \(z_r\) com multiplicidade \(m_r\), tal que \(m_1 + m_2 +\cdots + m_r = p\). A solução geral para a equação em diferença é \begin{equation} u_n \, = \, \frac{1}{z_1^n}P_1(n)+\frac{1}{z_2^n}P_2(n)+\cdots+\frac{1}{z_r^n}P_r(n), \end{equation} onde \(P_j(n)\), para \(j=1,\cdots,r\) é um polinômio em \(n\), de grau \(m_j-1\). Dadas as \(p\) condições iniciais \(u_0,\cdots,u_{p-1}\), podemos resolver para o \(P_j\) explicitamente.

Exemplo III.10. O ACF do processo \(AR(2)\).

Suponhamos que \(X_t=\phi_1 X_{t-1}+\phi_2 X_{t-2}+W_t\) seja um processo \(AR(2)\) causal. Multiplicando cada lado do modelo por \(X_{t-h}\) para \(h>0\) e tomado esperança obtemos \begin{equation} \mbox{E}(X_t X_{t-h}) \, = \, \phi_1\mbox{E}(X_{t-1}X_{t-h})+\phi_2\mbox{E}(X_{t-2}X_{t-h})+\mbox{E}(W_tX_{t-h})\cdot \end{equation} O resultado é \begin{equation} \gamma(h) \, = \, \phi_1 \gamma(h-1)+\phi_2 \gamma(h-2), \qquad h=1,2,\cdots \cdot \end{equation}

Para encontrarmos o resultado acima utilizamos o fato de que \(\mbox{E}(X_t)=0\) e que para \(h>0\), \begin{equation} \mbox{E}(W_t X_{t-h}) \, = \, \mbox{E}\Big( W_t\sum_{j=0}^\infty \phi_j W_{t-h-j}\Big) \, = \, 0\cdot \end{equation} Obtemos assim \begin{equation} \rho(h) -\phi_1 \rho(h-1)-\phi_2 \rho(h-2) \, = \, 0, \qquad h=1,2,\cdot\cdot \end{equation} As condições iniciais são \(\rho(0)=1\) e \(\rho(-1)=\phi_1/(1-\phi_2)\), as quais obtemos avaliando a expressão acima para \(h=1\) e notando que \(\rho(1)=\rho(-1)\).

Utilizando os resultados para a equação em diferença homogênea de ordem dois, sejam \(z_1\) e \(z_2\) as raízes do polinômio associado, \(\phi(z)=1-\phi_1 z-\phi_2 z^2\). Como o modelo é causal, sabemos que as raízes estão fora do círculo unitário \(|z_1|>1\) e \(|z_2|> 1\). Agora, considere a solução para três casos:

- (i) Quando \(z_1\) e \(z_2\) são reais distintos, então-estacioná \begin{equation} \rho(h)=\frac{c_1}{z_1^h}+\frac{c_2}{z_2^h}, \end{equation} assim \(\rho(h)\to 0\) exponencialmente rápido quando \(h\to\infty\).

- (ii) Quando \(z_1=z_2=z_0\) sejam reais e iguais, então \begin{equation} \rho(h)=\frac{c_1+c_2 h}{z_0^h}, \end{equation} assim \(\rho(h)\to 0\) exponencialmente rápido quando \(h\to\infty\).

- (iii) Quando \(z_1=\overline{z}_2\) são um de complexos conjugados, então \(c_2=\overline{c}_1\) porque \(\rho(h)\) é uma função real e \begin{equation} \rho(h)=\frac{c_1}{z_1^h}+\frac{\overline{c}_1}{\overline{z}_1^h}\cdot \end{equation} Escrevendo \(c_1\) e \(z_1\) em coordenadas polares, por exemplo, \(z_1 = |z_1|e^{i\theta}\), onde \(\theta\) é o ângulo cuja tangente é a razão entre a parte imaginária e a parte real de \(z_1\), às vezes chamada de \(arg(z_1)\), o intervalo de \(\theta\) é \([-\pi,\pi]\). Então, usando o fato de que \(e^{i\alpha} + e^{-i\alpha} = 2 \cos(\alpha)\), a solução tem a forma \begin{equation} \rho(h) \, = \, \dfrac{a}{|z_1|^h}\cos(h\theta+b), \end{equation} onde \(a\) e \(b\) são determinados pelas condições iniciais. Mais uma vez, \(\rho(h)\) amortece a zero exponencialmente rápido quando \(h\to\infty\), mas o faz de forma sinusoidal. A implicação desse resultado é mostrada no próximo exemplo.

Exemplo III.11. O processo \(AR(2)\) com raízes complexas.

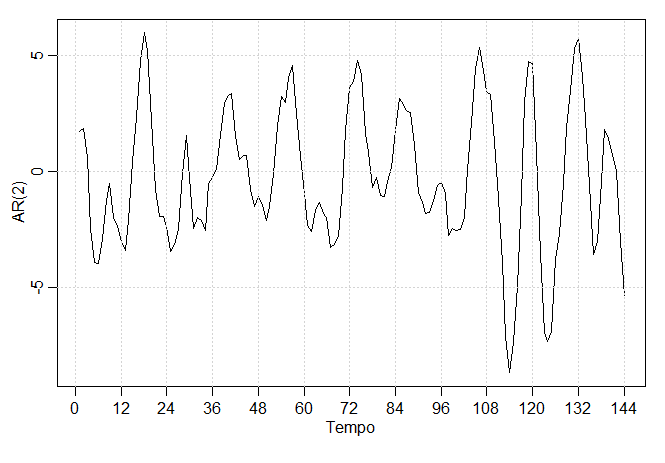

A figura abaixo mostra \(n=144\) observações do modelo \(AR(2)\) \begin{equation} X_t \, = \, 1.5 X_{t-1}-0.75 X_{t-2}+W_t, \end{equation} com \(\sigma_{_W}^2=1\) e com raízes complexas escolhidas para que o processo exiba um comportamento pseudocíclico à taxa de um ciclo a cada 12 pontos de tempo. O polinômio autoregressivo para este modelo é \(\phi(z)=1-1.5 z+0.75 z^2\). As raízes de \(\phi(z)\) são \(1\pm i/\sqrt{3}\) e \(\theta=\tan^{-1}(1/\sqrt{3})=2\pi/12\) radianos por unidade de tempo. Para converter o ângulo em ciclos por unidade de tempo, divida por 2 para obter 1/12 ciclos por unidade de tempo.

|

|---|

Para calcular as raízes do polinômio e resolver para \(arg\) em R:

O ACF para este modelo é:

|

|---|

Exemplo III.12. Os \(\psi\)-pesos para um modelo ARMA.

Para o modelo causal \(ARMA(p,q)\), \(\phi(B)X_t=\theta(B)W_t\), onde os zeros de \(\phi(B)\) estão fora do círculo unitário, lembre-se de que podemos escrever \begin{equation} X_t \, = \, \sum_{j=0}^\infty \psi_j W_{t-j}, \end{equation} sendo que os \(\psi\)-pesos são determinados pela Propriedade III.1

Para o modelo \(MA(p)\) puro, \(\psi_0=1\), \(\psi_j=\theta_j\), quando \(j=1,2,\cdots,q\) e \(\psi_j=0\), caso contrário. Para o caso geral de modelos \(ARMA(p,q)\), a tarefa de resolver para os \(\psi\)-pesos é muito mais complicada, como foi demonstrado no Exemplo III.8. O uso da teoria das equações em diferença homogêneas pode ajudar aqui. Para resolver para os \(\psi\)-pesos em geral, devemos combinar os coeficientes em \(\phi(z)\psi(z)=\theta(z)\): \begin{equation} (1-\phi z-\phi_2 z^2-\cdots)(\psi_0+\psi_1 z+\psi_2 z^2+ \cdots) \, = \, (1+\theta_1 z+\theta_2 z^2+\cdots)\cdot \end{equation}

Os primeiros valores são \begin{array}{rcl} \psi_1 & = & 1 \\ \psi_1-\phi_1\psi_0 & = & \theta_1 \\ \psi_2-\phi_1\psi_2-\phi_2\psi_1-\phi_3\psi_0 & = & \theta_2 \\ \psi_3-\phi_1\psi_2-\phi_2\psi_1-\phi_3\psi_0 & = & \theta_3 \\ \vdots & & \vdots \end{array} onde assumimos \(\phi_j=0\), para \(j>p\) e \(\theta_j=0\) caso \(j>p\). Os \(\psi\)-pesos satisfazem as equações em diferença homogêneas dadas por \begin{equation} \psi_j - \sum_{k=1}^p \phi_k \psi_{j-k} \, = \, 0, \qquad j\geq \max\{p,q+1\}, \end{equation} com condições iniciais \begin{equation} \psi_j - \sum_{k=1}^j \phi_k \psi_{j-k} \, = \, \theta_k, \qquad 0\leq j< \max\{p,q+1\}\cdot \end{equation} A solução geral depende das raízes do polinômio \(AR\), \(\phi(z)=1-\phi_1 z-\cdots-\phi_p z^p\). A solução específica dependerá, claro, das condições iniciais.

Considere o processo ARMA dado acima \(X_t=0.9X_{t-1}+0.5W_{t-1}+W_t\). Devido a \(\max\{p,q+1\}=2\), temos que \(\psi_0=1\) e \(\psi_1=0.9+0.5=1.4\). Pelo resultado das equações em diferença homogêneas para \(j=2,3,\cdots\), os \(\psi\)-pesos satisfazem \(\psi_j-0.9\psi_{j-1}=0\). A solução geral é \(\psi_j=c 0.9^j\). Para encontrar a solução específica, usamos a condição inicial \(\psi_1=1.4\), de manerira que \(1.4=0.9 c\) ou \(c=1.4/0.9\). Finalmente, \(\psi_j=1.4 (0.9)^{j-1}\) para \(j\geq 1\), como vimos no Exemplo III.8.

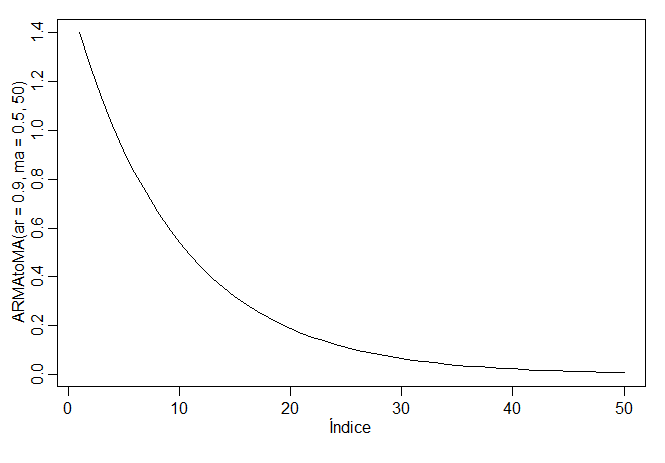

Para ver, por exemplo, os primeiros 50 \(\psi\)-pesos em R, use: |

|---|

III.3 Autocorrelação e autocorrelação parcial

Começamos exibindo o ACF de um processo \(MA(q)\), \(X_t=\theta(B)W_t\), onde \(\theta(B)=1+\theta_1 B+\cdots+\theta_q B^q\). Porque \(X_t\) é uma combinação linear finita de termos de ruído branco, o processo é estacionário com média \begin{equation} \mbox{E}(X_t) \, = \, \sum_{j=0}^q \theta_j \mbox{E}(W_{t-j}) \, = \, 0, \end{equation} onde escrevemos \(\theta_0=1\) e com função de autocovariância \begin{equation} \begin{array}{rcl} \gamma(h) \, = \, \mbox{Cov}(X_{t+h},X_t) & = & \mbox{Cov}\left( \displaystyle \sum_{j=0}^q \theta_jW_{t+h-j}, \sum_{k=0}^q \theta_k W_{t-k}\right) \\ & = & \displaystyle \left\{ \begin{array}{ccl} \displaystyle \sigma_{_W}^2\sum_{j=0}^{q-h} \theta_j\theta_{j+h}, & \mbox{quando} & 0\leq h\leq q \\ 0, & \mbox{quando} & h>q \end{array}\right.\cdot \end{array} \end{equation}

Lembrando que \(\gamma(h)=\gamma(-h)\), por isso somente exibiremos os valores para \(h\geq 0\). Observe que \(\gamma(q)\) não pode ser zero porque \(\theta_q\neq 0\). O corte de \(\gamma(h)\) após \(q\) lags é a assinatura do modelo \(MA(q)\). Dividindo a expressão acima por \(\gamma(0)\) produz o ACF de um \(MA(q)\): \begin{equation} \rho(h) \, = \, \displaystyle\left\{ \begin{array}{ccc} \frac{\displaystyle\sum_{j=0}^{q-h}\theta_j\theta_{j+h}}{\displaystyle1+\theta_1^2+\cdots+\theta_q^2}, & \mbox{quando} & 1\leq h\leq q \\ 0, & \mbox{quando} & h> q \end{array}\right. \end{equation}

Para um modelo \(ARMA(p,q)\) causal, \(\phi(B)X_t = \theta(B)W_t\), onde os zeros de \(\phi(z)\) estão fora do círculo unitário, escrevamos \begin{equation} X_t \, = \, \sum_{j=0}^\infty \psi_j W_{t-j}\cdot \end{equation} Segue-se imediatamente que \(\mbox{E}(X_t) = 0\) e a função de autocovariância de \(X_t\) é \begin{equation} \gamma(h) \, = \, \mbox{Cov}(X_{t+h},X_t) \, = \, \sigma_{_W}^2\sum_{j=0}^\infty \psi_j \psi_{j+h}, \qquad h\geq 0\cdot \end{equation} Poderíamos então utilizar equações acima para resolver os pesos. Por sua vez, poderíamos resolver por \(\gamma(h)\) e o ACF \(\rho(h)=\gamma(h)/\gamma(0)\). Como no Exemplo III.10, também é possível obter uma equação em diferença homogênea diretamente em termos de \(\gamma(h)\). Primeiro, escrevemos \begin{equation} \begin{array}{rcl} \gamma(h) & = & \mbox{Cov}(X_{t+h},X_t) \, = \, \mbox{Cov}\left( \displaystyle\sum_{j=1}^p\phi_j X_{t+h-j}+\sum_{j=0}^q\theta_j W_{t+h-j}, X_t\right) \\ & = & \displaystyle\sum_{j=1}^p \phi_j\gamma(h-j) \, + \, \sigma_{_W}^2\sum_{j=k}^q \theta_j\psi_{j-h}, \qquad h\geq 0, \end{array} \end{equation} onde usamos o fato de que, para \(h\geq 0\), \begin{equation} \mbox{Cov}(W_{t+h-j},X_t) \, = \, \displaystyle\mbox{Cov}(W_{t+h-j},\sum_{k=0}^\infty \psi_k W_{t-k}) \, = \, \psi_{j-h}\sigma_{_W}^2\cdot \end{equation}

Assim, podemos escrever a equação homogênea geral para o ACF de um processo \(ARMA\) causal: \begin{equation} \gamma(h) - \phi_1 \gamma(h-1)-\cdots-\phi_p\gamma(h-p) \, = \, 0, \qquad h\geq \max\{p,q+1\}, \end{equation} com condições iniciais \begin{equation} \gamma(h)-\sum_{j=1}^p \phi_j \gamma(h-j) \, = \, \sigma_{_W}^2\sum_{j=h}^q\theta_j \psi_{j-h}, \qquad 0\leq h < \max\{p,q+1\} \end{equation} Dividindo por \(\gamma(0)\) nos permitirá resolver para o ACF, \(\rho(h)=\gamma(h)/\gamma(0)\).

Exemplo III.13. O ACF para um modelo \(AR(p)\).

No Exemplo III.10 consideramos o caso \(p=2\). Numa situação geral, segue que \begin{equation} \rho(h) -\phi_1\rho(h-1)-\cdots-\phi_p \rho(h-p)\, = \, 0, \qquad h\geq p\cdot \end{equation}

Sejam \(z_1,\cdots,z_r\) as raízes de \(\phi(z)\), cada com multiplicidade \(m_1,\cdots,m_r\), respectivamente, onde \(m_1+\cdots+m_r=p\). Então, a solução geral é \begin{equation} \rho(h) \, = \, \frac{1}{z_1^h}P_1(h)+\frac{1}{z_2^h}P_2(h)+\cdots+\frac{1}{z_r^h}P_r(h), \qquad h\geq p, \end{equation} onde \(P_j(h)\) é um polinômio em \(h\) de grau \(m_j-1\).

Lembre-se que, para um modelo causal, todas as raízes estão fora do círculo unitário, \(|z_i|>1\), \(i=1,\cdots,r\). Se todas as raízes são reais, então \(\rho(h)\) amortece exponencialmente rápido a zero quando \(h\to\infty\). Se algumas das raízes são complexas, então elas estarão em pares conjugados e \(\rho(h)\) irá amortecer, de uma maneira sinusoidal, exponencialmente rápido a zero quando \(h\to\infty\). No caso de raízes complexas, a série temporal parecerá ser de natureza cíclica. Isso, é claro, também é verdadeiro para modelos ARMA nos quais a parte AR possui raízes complexas.

Exemplo III.14. O ACF para um modelo \(ARMA(1,1)\).

Consideremos o processo \(ARMA(1,1)\) dado por \(X_t=\phi X_{t-1}+\theta W_{t-1}+W_t\), onde \(|\phi|< 1\). Com base na equação homogênea geral para o ACF de um processo ARMA causal, a função de autocovariância satisfaz \begin{equation} \gamma(h)-\phi \gamma(h-1) \, = \, 0, \qquad h=2,3,\cdots, \end{equation} e segue que, a solução geral é \begin{equation} \gamma(h) \, = \, c\phi^h, \qquad h=1,2,\cdots, \end{equation} com condições iniciais \begin{equation} \gamma(0) \, = \, \phi\gamma(1)+\sigma_{_W}^2 \big( 1+\theta\phi+\theta^2\big) \qquad \mbox{e} \qquad \gamma(1) \, = \, \phi\gamma(0)+\sigma_{_W}^2\theta\cdot \end{equation}

Resolvendo para \(\gamma(0)\) e \(\gamma(1)\), obtemos que: \begin{equation} \gamma(0) \, = \, \sigma_{_W}^2\dfrac{1+2\theta\phi+\theta^2}{1-\phi^2} \qquad \mbox{e} \qquad \gamma(1) \, = \, \sigma_{_W}^2\dfrac{(1+\theta\phi)(\phi+\theta)}{1-\phi^2}\cdot \end{equation} Resolvendo para \(c\), temos \(\gamma(1)=c\phi\) ou \(c=\gamma(1)/\phi\). Portanto, a solução específica para \(h\geq 1\) é \begin{equation} \gamma(h) \, = \, \frac{\gamma(1)}{\phi}\phi^h \, = \, \sigma_{_W}^2\dfrac{(1+\theta\phi)(\phi+\theta)}{1-\phi^2}\phi^{h-1}\cdot \end{equation}

Finalmente, dividindo por \(\gamma(0)\) produz o ACF \begin{equation} \rho(h) \, = \, \dfrac{(1+\theta\phi)(\phi+\theta)}{1+2\theta\phi+\theta^2}\phi^{h-1}, \qquad h\geq 1\cdot \end{equation} Observe que o padrão geral de \(\rho(h)\) versus \(h\) acima não é diferente do de um \(AR(1)\). Portanto, é improvável que possamos diferenciar entre um \(ARMA(1,1)\) e um \(AR(1)\) baseado somente em um ACF estimado a partir de uma amostra. Essa consideração nos levará à função de autocorrelação parcial.

A função de autocorrelação parcial (PACF)

Vimos que para modelos \(MA(q)\), o ACF será zero para defasagens maiores que \(q\). Além disso, porque \(\theta_q\neq 0\), o ACF não será zero no atraso ou lag \(q\). Assim, o ACF fornece uma quantidade considerável de informações sobre a ordem da dependência quando o processo é de médias móveis. Se o processo, no entanto, é ARMA ou AR, o ACF sozinho nos diz pouco sobre as ordens de dependência. Assim, vale a pena buscar uma função que se comportará como o ACF dos modelos MA, mas para os modelos AR, a saber, a função de autocorrelação parcial (PACF).

Lembre-se que se \(X\), \(Y\) e \(Z\) forem variáveis aleatórias, então a correlação parcial entre \(X\) e \(Y\), dada por \(Z\), é obtida pela regressão de \(X\) em \(Z\) para obter \(\widehat{X}\), regredindo \(Y\) em \(Z\) para obter \(\widehat{Y}\) e então calculando \begin{equation} \rho_{_{XY|Z}} \, = \, \mbox{Corr}\big(X-\widehat{X},Y-\widehat{Y} \big)\cdot \end{equation}

A idéia é que \(\rho_{_{XY|Z}}\) mede a correlação entre \(X\) e \(Y\) com o efeito linear de \(Z\) removido ou parcialmente excluído. Se as variáveis são multivariadas normais, então esta definição coincide com \begin{equation} \rho_{_{XY|Z}} \, = \, \mbox{Corr}(X,Y|Z)\cdot \end{equation}

Para motivar a ideia para séries temporais, considere um modelo causal \(AR(1)\), \(X_t=\phi X_{t-1}+W_t\). Então, \begin{equation} \begin{array}{rcl} \gamma_{_X}(2) \, = \, \mbox{Cov}(X_t,X_{t-2}) & = & \mbox{Cov}(\phi X_{t-1}+W_t,X_{t-2}) \\ & = & \mbox{Cov}(\phi^2 X_{t-2}+\phi W_{t-1}+W_t, X_{t-2}) \, = \, \phi^2 \gamma_{_X}(0)\cdot \end{array} \end{equation}

Este resultado é decorrente da causalidade, pois \(X_{t-2}\) envolve \(\{W_{t-2},W_{t-3},\cdots\}\) que são todos não correlacionados com \(W_t\) e \(W_{t-1}\). A correlação entre \(X_t\) e \(W_{t-1}\) não é zero, como seria para um \(MA(1)\), porque \(X_t\) é dependente de \(X_{t-2}\) através de \(X_{t-1}\). Suponha que quebremos essa cadeia de dependência removendo ou retirando o efeito de \(X_{t-1}\). Ou seja, consideramos a correlação entre \(X_t-\phi X_{t-1}\) e \(X_{t-2}-\phi X_{t-1}\), porque é a correlação entre \(X_t\) e \(X_{t-2}\) com a dependência linear removida de cada um em \(X_{t-1}\). Desta forma, quebramos a cadeia de dependência entre \(X_t\) e \(X_{t-2}\). De fato, \begin{equation} \mbox{cov}(X_t-\phi X_{t-1},X_{t-2}-\phi X_{t-1}) \, = \, \mbox{Cov}(W_t, X_{t-2}-\phi X_{t-1}) \, = \, 0\cdot \end{equation} Assim, a ferramenta que precisamos é a autocorrelação parcial, que é a correlação entre \(X_s\) e \(X_t\) com o efeito linear de tudo no meio removido.

Para definir formalmente o PACF para séries temporais estacionárias de média zero, seja \(\widehat{X}_{t+h}\), para \(h\geq 2\), denote a regressão de \(X_{t+h}\) em \(\{X_{t+h-1},X_{t+h-2},\cdots,X_{t+1}\}\), que escrevemos como \begin{equation} \widehat{X}_{t+h} \, = \, \beta_1 X_{t+h-1}+\beta_2 X_{t+h-2}+\cdots+\beta_{h-1} X_{t+1}\cdot \end{equation} O termo regressão aqui se refere à regressão no sentido da população. Isso é, \(\widehat{X}_{t+h}\) é a combinação linear de \(\{X_{t+h-1},X_{t+h-2},\cdots,X_{t+1}\}\) que minimiza o erro quadrático médio \begin{equation} \mbox{E}\Big(X_{t+h}-\sum_{j=1}^{h-1} \alpha_j X_{t+j}\Big)^2\cdot \end{equation}

Observe que nenhum termo de intercepto é necessário porque a média de \(X_t\) é zero, caso contrário, substitua \(X_t\) por \(X_t\mu_X\) nesta discussão. Além disso, se \(\widehat{X}_t\) denota a regressão de \(X_t\) em \(\{X_{t+h-1},X_{t+h-2},\cdots,X_{t+1}\}\) então \begin{equation} \widehat{X}_t \, = \, \beta_1 X_{t+1}+\beta_2 X_{t+2}+\cdots+\beta_{h-1} X_{t+h-1}\cdot \end{equation}

Por causa da estacionariedade, os coeficientes, \(\beta_1,\cdots,\beta_{h-1}\) são os mesmos nos modelos de regressão acima. Vamos explicar este resultado na próxima seção, mas será evidente a partir dos exemplos.

A função de autocorrelação parcial (PACF) de um processo estacionário, \(X_t\), denotada por \(\phi_{h,h}\), para \(h=1,2,\cdots\) é \begin{equation} \phi_{1,1} \, = \, \mbox{Corr}(X_{t+1},X_t) \, = \, \rho(1) \end{equation} e \begin{equation} \phi_{h,h} \, = \, \mbox{Corr}\big(X_{t+h}-\widehat{X}_{t+h},X_t-\widehat{X}_t\big), \qquad h\geq 2\cdot \end{equation}

A razão para usar um subscrito duplo ficará evidente na próxima seção. O PACF \(\phi_{h,h}\) é a correlação entre \(X_{t+h}\) e \(X_t\) com a dependência linear de \(\{X_{t+1},\cdots,X_{t+h-1}\}\) em cada, removido. Se o processo \(X_t\) é gaussiano, então \(\phi_{h,h}=\mbox{Corr}(X_{t+h},X_t|X_{t+1},\cdots,X_{t+h-1})\), isto é, \(\phi_{h,h}\) é o coeficiente de correlação entre \(X_{t+h}\) e \(X_t\) na distribuição bivariada de \((X_{t+h},X_t)\) condicional em \(\{X_{t+1},\cdots,X_{t+h-1}\}\).

Exemplo III.15. A PACF para um modelo \(AR(1)\).

Considere a PACF do processo \(AR(1)\) dado por \(X_t=\phi X_{t-1}+W_t\), com \(|\phi|<1\). Por definição, \(\phi_{1,1}=\rho(1)=\phi\). Para calcular \(\phi_{2,2}\), considere a regressão de \(X_{t+2}\) em \(X_{t+1}\), digamos \(\widehat{X}_{t+2}=\beta X_{t+1}\). Escolhemos \(\beta\) minimizando \begin{equation} \mbox{E}\big( X_{t+2}-\widehat{X}_{t+2}\big)^2 \, = \, \mbox{E}\big( X_{t+2}-\beta X_{t+1}\big)^2 \, = \, \gamma(0)-2\beta \gamma(1)+\beta^2\gamma(0)\cdot \end{equation}

Tomando derivadas em relação a \(\beta\) e definindo o resultado igual a zero, temos \(\beta=\gamma(1)/\gamma(0)=\rho(1)=\phi\). Em seguida, considere a regressão de \(X_t\) em \(X_{t+1}\), digamos \(\widehat{X}_t=\beta X_{t+1}\). Escolhemos \(\beta\) minimizando \begin{equation} \mbox{E}\big( X_t-\widehat{X}_t\big)^2 \, = \, \mbox{E}\big( X_{t}-\beta X_{t+1}\big)^2 \, = \, \gamma(0)-2\beta\gamma(1)+\beta^2\gamma(0)\cdot \end{equation} Esta é a mesma equação de antes, então \(\beta=\phi\). Consequentemente, \begin{equation} \begin{array}{rcl} \phi_{2,2} & = & \mbox{Corr}\big(X_{t+2}-\widehat{X}_{t+2},X_t-\widehat{X}_t\big) \, = \, \mbox{Corr}(X_{t+2}-\phi X_{t+1},X_t-\phi X_{t+1}) \\ & = & \mbox{Corr}(W_{t+2}, X_t-\phi X_{t+1}) \, = \, 0, \end{array} \end{equation} por causalidade. Portanto, \(\phi_{2,2}=0\). No próximo exemplo, veremos que neste caso, \(\phi_{h,h}=0\) para todo \(h>1\).

Exemplo III.16. O PACF para um modelo \(AR(p)\).

Este modelo implica que \(X_{t+h}=\sum_{j=1}^p \phi_j X_{t+h-j}+W_{t+h}\), onde as raízes de \(\phi(z)\) estão fora do círculo unitário. Quando \(h>p\), a regressão de \(X_{t+h}\) em \(\{X_{t+1},\cdots,X_{t+h-1}\}\), é \begin{equation} \widehat{X}_{t+h} \, = \, \sum_{j=1}^p \phi_j X_{t+h-j}\cdot \end{equation}

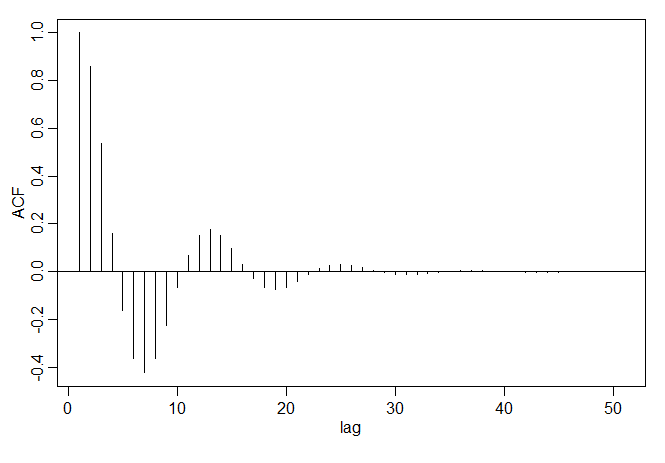

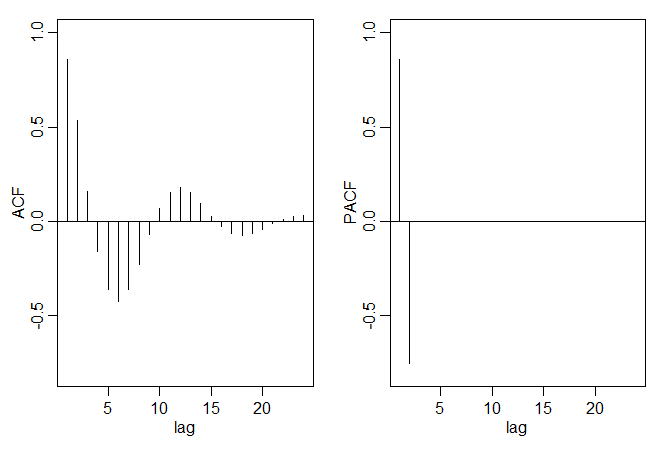

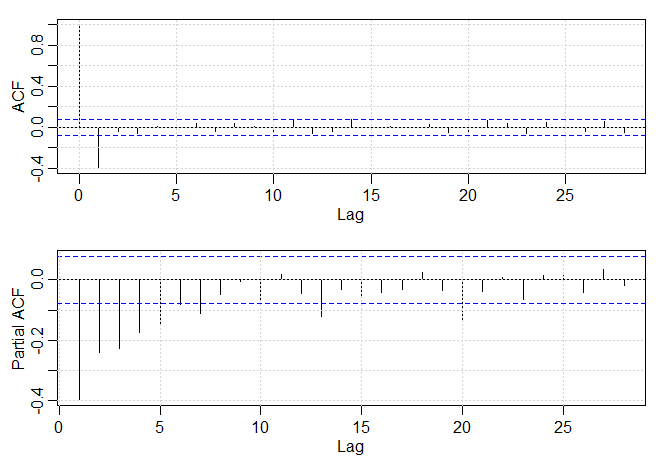

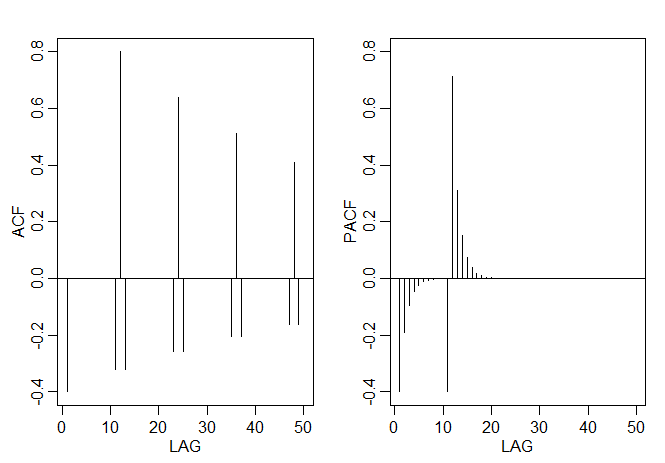

Ainda não provamos este resultado, mas vamos provar isso na próxima seção. Assim, quando \(h>p\), \begin{equation} \phi_{h,h} \, = \, \mbox{Corr}\big( X_{t+h}-\widehat{X}_{t+h}, X_t-\widehat{X}_t\big) \, = \, \mbox{Corr}\big( W_{t+h},X_t-\widehat{X}_t\big) \, = \, 0, \end{equation} porque, pela causalidade, \(X_t-\widehat{X}_t\) depende somente de \(\{W_{t+h-1},W_{t+h-2},\cdots\}\). Quando \(h\leq p\), \(\phi_{h,h}\) é não zero e \(\phi_{1,1},\cdots,\phi_{p-1,p-1}\) não são necessariamente zero. Veremos mais tarde que, de fato, \(\phi_{p,p}=\phi_p\). Mostramos na figura abaixo as funções ACFe PACF para o modelo \(AR(2)\) presente no Exemplo III.11.

Para reproduzir a figura em R, use os seguintes comandos: |

|---|

Exemplo III.17. A PACF para um modelo \(MA(q)\) invertível.

Para um modelo \(MA(q)\) invertível, escrevemos \begin{equation} X_t=-\sum_{j=1}^\infty \phi_j X_{t-j}+W_t\cdot \end{equation} Além disso, não existe representação finita. A partir deste resultado, deve ficar claro que o PACF nunca será cortado, como no caso do \(AR(p)\).

Para um \(MA(1)\), \(X_t=W_t+\theta W_{t-1}\), com \(|\theta|< 1\), cálculos semelhantes ao Exemplo III.15 produzirão \begin{equation} \phi_{2,2}=-\frac{\theta^2}{1+\theta^2+\theta^4}\cdot \end{equation} Para o \(MA(1)\) em geral, podemos mostrar que \begin{equation} \phi_{h,h} \, = \, -\frac{(-\theta)^h(1-\theta^2)}{1-\theta^{2(h+1)}}, \qquad h\geq 1\cdot \end{equation}

Na próxima seção, discutiremos métodos de cálculo da função de autocorrelação parcial (PACF). A função de autocorrelação parcial (PACF) para modelos MA se comporta de maneira semelhante ao ACF para modelos AR. Além disso, o PACF para modelos de AR comporta-se muito como o ACF para os modelos MA. Como um modelo ARMA invertível tem uma representação AR infinita, o PACF não será cortado. Podemos resumir esses resultados na tabela a seguir.

| \(AR(p)\) | \(MA(q)\) | \(ARMA(p,q)\) | |||||||

|---|---|---|---|---|---|---|---|---|---|

| \(ACF\) | Caudas fora | Corta fora | Caudas fora | ||||||

| depois lag \(q\) | |||||||||

| \(PACF\) | Corta fora | Caudas fora | Caudas fora | ||||||

| depois lag \(p\) |

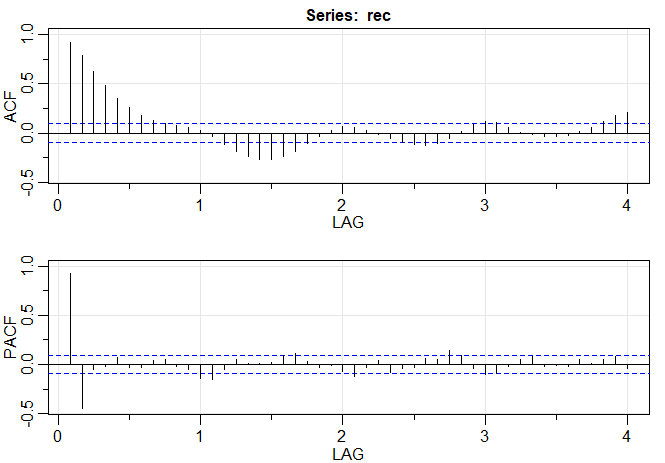

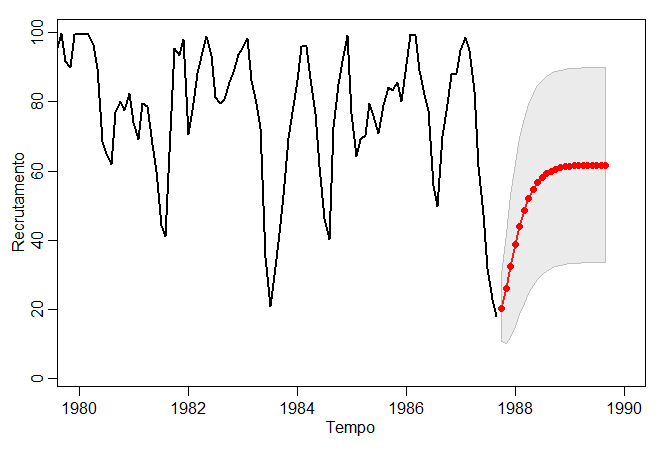

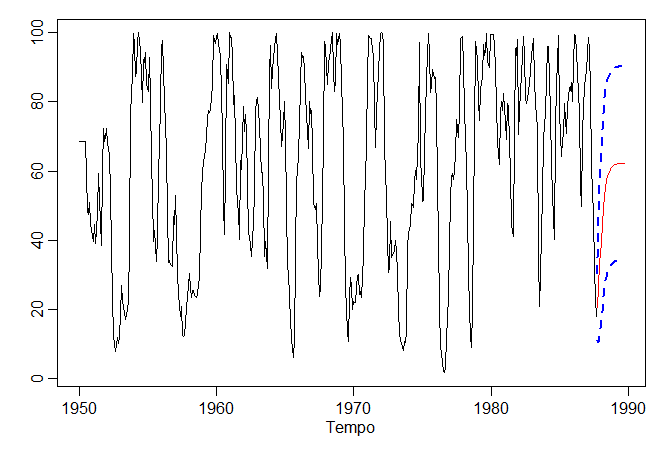

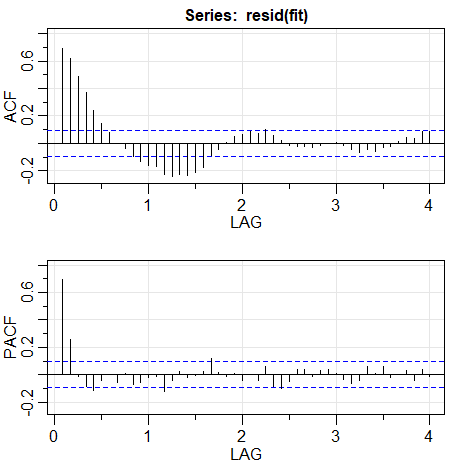

Exemplo III.18. Análise preliminar da série de Recrutamento.

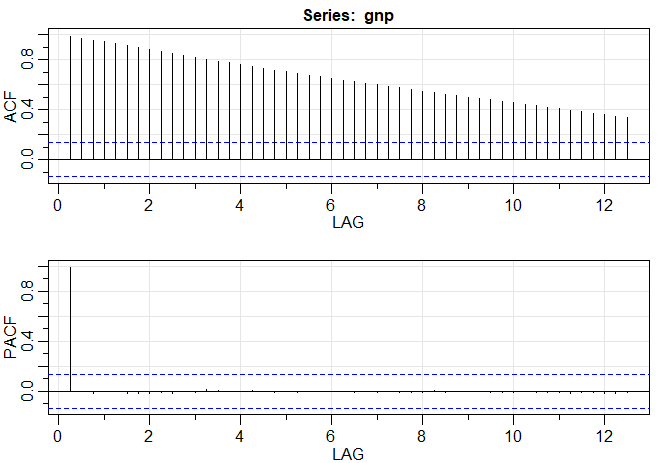

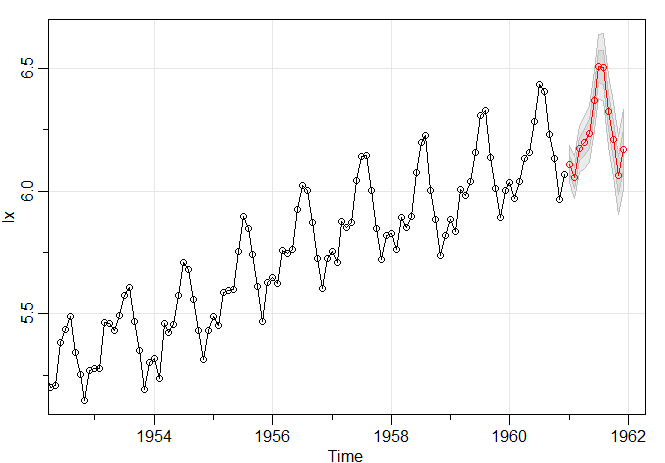

Consideramos o problema de modelagem da série Recrutamento mostrada no Exemplo I.5. Há 453 meses de Recrutamento observado variando ao longo dos anos 1950 a 1987. O ACF e o PACF amostrais, mostrados na figura abaixo, são consistentes com o comportamento de um \(AR(2)\). O ACF tem ciclos correspondendo aproximadamente a um período de 12 meses e o PACF tem valores grandes para \(h = 1,2\) e, em seguida, é essencialmente zero para atrasos ou lag de ordem superior. Com base na Tabela III.1, esses resultados sugerem que um modelo autorregressivo de segunda ordem, ou seja, \(p = 2\) pode fornecer um bom ajuste. Embora discutiremos a estimação em detalhes na Seção III.5, executamos uma regressão usando os trios de dados \(\{(X;Z_1,Z_2) \, : \,(X_3;X_2,X_1),(X_4;X_3,X_2),\cdots,(X_{453};X_{452},X_{451})\}\) para ajustar um modelo da forma \begin{equation} X_t \, = \, \phi_0 +\phi_1 X_{t-1}+\phi_2 X_{t-2} +W_t, \end{equation} para \(t=3,4,\cdots,453\). As estimativas e os erros padrão (entre parênteses) são \(\widehat{\phi}_0=6.74_{(1.11)}\), \(\widehat{\phi}_1=1.35_{(0.04)}\), \(\widehat{\phi}_2=-0.46_{(0.04)}\) e \(\widehat{\sigma}_{_W}^2=89.72\).

|

|---|

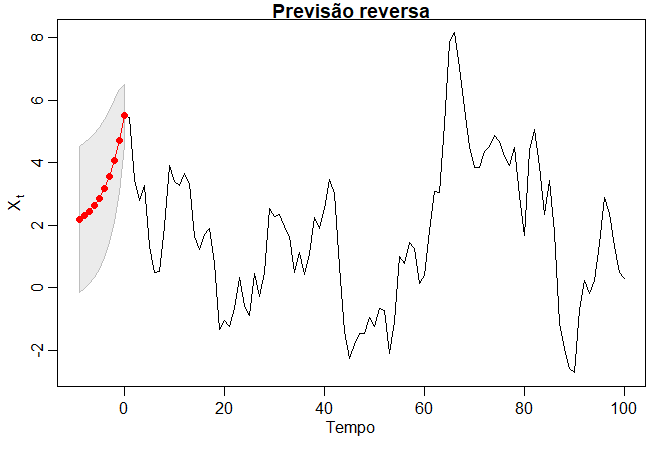

III.4 Previsão

Na previsão, o objetivo é prever valores futuros de uma série temporal \(X_{n+m}\), \(m=1,2,\cdots\) com base nos dados coletados até o presente, \(X_{1:n}=\{X_1,X_2,\cdots,X_n\}\). Ao longo desta seção, assumiremos que \(X_t\) é estacionário e os parâmetros do modelo são conhecidos. O problema de previsão quando os parâmetros do modelo são desconhecidos será discutido na próxima seção. O preditor de erro quadrático médio mínimo de \(X_{n+m}\) é \begin{equation} X_{n+m}^n \, = \, \mbox{E}(X_{n+m} \, | \, X_{1:n}), \end{equation} porque a esperança condicional minimiza o erro quadrático médio \begin{equation} \mbox{E}\big(X_{n+m}-g(X_{1:n}) \big)^2, \end{equation} onde \(g(\cdot)\) é uma função das observações \(X_{1:n}\).

Primeiro, vamos restringir a atenção aos preditores que sejam funções lineares dos dados, ou seja, preditores da forma \begin{equation} X_{n+m}^n \, = \,\alpha_0 +\sum_{k=1}^n \alpha_k X_k, \end{equation} onde \(\alpha_0,\alpha_1,\cdots,\alpha_n\) são números reais. Notamos que os \(\alpha\)'s dependem de \(n\) e \(m\), mas por enquanto abandonamos a dependência da notação. Por exemplo, se \(n = m = 1\), então \(X_2^1\) é a previsão linear de um passo à frente de \(X_2\) dado \(X_1\). Em termos da expressão acima, \(X_2^1=\alpha_0 +\alpha_1 X_1\). Mas se \(n=2\), \(X_3^2\) é a previsão linear de um passo à frente de \(X_3\) dado \(X_1\) e \(X_2\), ou seja, \(X_3^2=\alpha_0+\alpha_1 X_1+\alpha_2 X_2\) e, em geral, os \(\alpha\)'s em \(X_2^1\) e \(X_3^2\) são diferentes.

Os preditores lineares que minimizam o erro quadrático médio são chamados de melhores preditores lineares (BLPs). Como veremos, a previsão linear depende apenas dos momentos de segunda ordem do processo, que são fáceis de estimar a partir dos dados. Grande parte do material desta seção é aprimorada pelo material teórico apresentado no Apêndice B. Por exemplo, o Teorema B.3 afirma que, se o processo for Gaussiano, os preditores de erro quadrático médio mínimo e os melhores preditores lineares serão os mesmos. A seguinte propriedade, baseada no Teorema da Projeção, Teorema B.1, é um resultado chave.

Dados os dados \(X_1,X_2,\cdots,X_n\), o melhor preditor linear \(\displaystyle X_{n+m}^n=\alpha_0+\sum_{k=1}^n \alpha_k X_k\), de \(X_{n+m}\) para \(m\geq 1\), é encontrado resolvendo \begin{equation} \mbox{E}\big( (X_{n+m}-X_{n+m}^n)X_k\big) \, = \, 0, \qquad k=0,1,\cdots,n, \end{equation} onde \(X_0=1\), para \(\alpha_0,\alpha_1,\cdots,\alpha_n\).

As equações especificadas no Teorema III.3 são chamadas de equações de predição e são usadas para resolver os coeficientes \(\{\alpha_0,\alpha_1,\cdots,\alpha_n\}\). Os resultados do Teorema III.3 também podem ser obtidos através de mínimos quadrados; isto é, minimizando \(Q = \mbox{E}(X_{n+m}-\sum_{k=0}^n \alpha_k X_k)^2\) com respeito aos \(\alpha\)'s, resolvendo \(\partial Q/\partial \alpha_j = 0\) para \(\alpha_j\), \(j = 0,1,\cdots,n\). Isso leva ao resultado no Teorema III.3.

Se \(\mbox{E}(X_t)=\mu\), a primeira equação (k=0) na Proposição III.3 implica que \begin{equation} \mbox{E}(X_{n+m}^n) \, = \, \mbox{E}(X_{n+m}) \, = \, \mu\cdot \end{equation} Então, tomando esperança, temos \begin{equation} \mu \, = \, \alpha_0+\sum_{k=1}^n \alpha_k \mu \qquad \mbox{ou} \qquad \alpha_0 \,= \, \mu\Big( 1-\sum_{k=1}^n \alpha_k\Big)\cdot \end{equation} Assim, a forma do BLP é \begin{equation} X_{n+m}^n \, = \, \mu +\sum_{k=1}^n \alpha_k (X_k-\mu)\cdot \end{equation} Assim, até discutirmos a estimação, não há perda de generalidade ao considerar o caso que \(\mu= 0\), em cujo caso, \(\alpha_0 = 0\).

Primeiro, considere a previsão de um passo à frente. Isto é, dado \(\{X_1,\cdots,X_t\}\), desejamos prever o valor da série temporal no próximo ponto de tempo, \(X_{n+1}\). O BLP de \(X_{n+1}\) é da forma \begin{equation} X_{n+1}^n \, = \, \phi_{n,1} X_n+\phi_{n,2}X_{n-1}+\cdots+\phi_{n,n}X_1, \end{equation} onde agora mostramos a dependência dos coeficientes em \(n\); nesse caso \(\alpha_k\) no preditor linear é \(\phi_{n,n+1-k}\) na expressão acima, para \(k=1,\cdots,n\). Utilizando o Teorema III.3, os coeficientes \(\{\phi_{n,1},\phi_{n,2},\cdots,\phi_{n,n}\}\) satisfazem \begin{equation} \displaystyle\mbox{E}\left( \Big( X_{n+1}-\sum_{j=1}^n \phi_{n,j}X_{n+1-j}\Big)X_{n+1-k} \right)\, = \, 0, \qquad k=1,\cdots,n, \end{equation} ou \begin{equation} \sum_{j=1}^n \phi_{n,j}\gamma(k-j) \, = \, \gamma(k), \qquad k=1,2\cdots,n\cdot \end{equation}

As equações de predição acima podem ser escritas em notação matricial como \begin{equation} \Gamma_n \phi_n \, = \, \gamma_n, \end{equation} onde \(\displaystyle\Gamma_n=\{\gamma(k-j)\}_{j,k=1}^n\) é uma matriz \(n\times n\), \(\phi_n=(\phi_{n,1},\cdots,\phi_{n,n})^\top\) é um vetor \(n\times 1\) e \(\gamma_n=(\gamma(1),\cdots,\gamma(n))^\top\) é um vetor \(n\times 1\).

A mariz \(\Gamma_n\) é definida não negativa. Se \(\Gamma_n\) é singular, existem muita soluções mas, pelo Teorema de projeção (Teorema B.1), \(X_{n+1}^n\) é única. Se \(\Gamma_n\) é não singular, os elementos de \(\phi_n\) são únicos e dados por \begin{equation} \phi_n \, = \, \Gamma_n^{-1}\gamma_n\cdot \end{equation}

Para os modelos \(ARMA\), o fato de \(\sigma_{_W}^2>0\) e \(\lim_{h\to\infty}\gamma(h)=0\) é o suficiente para garantir que \(\Gamma_n\) seja definido positivo. Às vezes é conveniente escrever a previsão de um passo à frente na notação vetorial \begin{equation} X_{n+m}^n \, = \, \phi_n^\top X, \end{equation} onde \(X=(X_n,X_{n-1},\cdots,X_1)^\top\).

O erro médio de previsão quadrado de um passo à frente é \begin{equation} P_{n+1}^n \, = \, \mbox{E}\big(X_{n+1}-X_{n+1}^n \big)^2 \, = \, \gamma(0)-\gamma_n^\top \Gamma_n^{-1}\gamma_n\cdot \end{equation} Para verifiarmos a expressão acima, vemos que \begin{equation} \begin{array}{rcl} \mbox{E}\big(X_{n+1}-X_{n+1}^n \big)^2 & = & \mbox{E}\big(X_{n+1}-\phi_n^\top X \big)^2 \, = \, \mbox{E}\big(X_{n+1}-\gamma_n^\top \Gamma_n^{-1}X \big)^2 \\ & = & \mbox{E}\big(X_{n+1}^2-2\gamma_n^\top \Gamma_n^{-1}X X_{n+1}+\gamma_n^\top\Gamma_n^{-1}X X^\top \Gamma_n^{-1}\gamma_n \big) \\ & = & \gamma(0)-2\gamma_n^\top \Gamma_n^{-1}\gamma_n+\gamma_n^\top \Gamma_n^{-1}\Gamma_n\Gamma_n^{-1}\gamma_n \\ & = & \gamma(0)-\gamma_n^\top \Gamma_n^{-1}\gamma_n\cdot \end{array} \end{equation}

Exemplo III.19. Previsão para o modelo \(AR(2)\).

Suponhamos o processo \(AR(2)\) causal, \(X_t=\phi_1 X_{t-1}+\phi_2 X_{t-2} +W_t\) e uma observação \(X_t\). Então, usando \(\phi_n \, = \, \Gamma_n^{-1}\gamma_n\), a previsão um passo à frente de \(X_2\) baseada em \(X_1\) é \begin{equation} X_2^1 \, = \, \phi_{1,1}X_1 \, = \, \frac{\gamma(1)}{\gamma(0)}X_1 \, = \, \rho(1)X_1\cdot \end{equation}

Agora, suponha que queremos a previsão de \(X_3\) com um passo à frente com base em duas observações \(X_1\) e \(X_2\), ou seja, \(X_3^2 \, = \, \phi_{2,1}X_2 +\phi_{2,2} X_1\). Poderíamos usar que \(\sum_{j=1}^n \phi_{n,j}\gamma(k-j) \, = \, \gamma(k)\), para \(k=1,2\cdots,n\), \begin{equation} \begin{array}{rcl} \psi_{2,1}\gamma(0)+\phi_{2,2}\gamma(1) & = & \gamma(1) \\ \phi_{2,1}\gamma(1)+\phi_{2,2}\gamma(0) & = & \gamma(2), \end{array} \end{equation} para resolver por \(\phi_{2,1}\) e \(\phi_{2,2}\) ou utilizando a forma matricial e resolver \begin{equation} \begin{pmatrix} \phi_{2,1} \\ \phi_{2,2}\end{pmatrix} \, = \, \begin{pmatrix} \gamma(0) & \gamma(1) \\ \gamma(1) & \gamma(0)\end{pmatrix}^{-1} \begin{pmatrix} \gamma(1) \\ \gamma(2) \end{pmatrix}, \end{equation} mas, deve ser aparente do modelo que \(X_3^2 = \phi_1 X_2+\phi_2 X_1\). Devido a que \(\phi_1 X_2+\phi_2 X_1\) satisfaz as equações de predição no Teorema III.3, \begin{equation} \begin{array}{rcl} \mbox{E}\left( \big( X_3-(\phi_1 X_2+\phi_2 X_1)\big)X_1\right) & = & \mbox{E}(W_3 X_1) \, = \, 0, \\ \mbox{E}\left( \big( X_3-(\phi_1 X_2+\phi_2 X_1)\big)X_2\right) & = & \mbox{E}(W_3 X_2) \, = \, 0, \end{array} \end{equation} segue-se que, de fato, \(X_3^2 = \phi_1 X_2+\phi_2 X_1\) e pela unicidade dos coeficientes, neste caso, \(\phi_{2,1}=\phi_1\) e \(\phi_{2,2}=\phi_2\). Continuando desta forma, verificamos que, para \(n\geq 2\), \begin{equation} X_{n+1}^n \, = \, \phi_1 X_n+\phi_2 X_{n-1}\cdot \end{equation} Isto é, \(\phi_{n,1}=\phi_1\), \(\phi_{n,2}=\phi_2\) e \(\phi_{n;j}=0\), para \(j=3,4,\cdots,n\).

A partir do Exemplo III.19, deve ficar claro que, se a série temporal é um processo causal \(AR(p)\), então, para \(n\geq p\), \begin{equation} X_{n+1}^n \, = \, \phi_1 X_n+\phi_2 X_{n-1}+\cdots+\phi_p X_{n-p+1}\cdot \end{equation} Para os modelos ARMA em geral, as equações de predição não serão tão simples quanto o caso AR puro. Além disso, para \(n\) grande, o uso de sistemas de equações é proibitivo porque requer a inversão de uma matriz grande. Existem, no entanto, soluções iterativas que não exigem nenhuma inversão de matrizes. Em particular, mencionamos a solução recursiva devido a Levinson (1947) e Durbin (1960).

As equações \(\phi_n = \Gamma_n^{-1}\gamma_n\) e \(P_{n+1}^n = \mbox{E}\big(X_{n+1}-X_{n+1}^n \big)^2 \, = \, \gamma(0)-\gamma_n^\top \Gamma_n^{-1}\gamma_n\) podem ser resolvidas iterativamente como segue: \begin{equation} \phi_{0,0} \, = \, 0, \qquad P_1^0 \, = \, \gamma(0)\cdot \end{equation} Para \(n\geq 1\), \begin{equation} \phi_{n,n} \, = \, \frac{\displaystyle \rho(n)-\sum_{k=1}^{n-1} \phi_{n-1,k}\, \rho(n-k)} {\displaystyle 1-\sum_{k=1}^{n-1} \phi_{n-1,k}\, \rho(k)}, \qquad P_{n+1}^n \, = \, P_{n}^{n-1}(1-\phi_{n,n}^2), \end{equation} onde, para \(n\geq 2\) \begin{equation} \phi_{n,k} \, = \, \phi_{n-1,k} -\phi_{n,n}\phi_{n-1,n-k}, \qquad k=1,2,\cdots,n-1\cdot \end{equation}

Exemplo III.20. Utilizando o algoritmo de Durbin-Levinson.

Para usar o algoritmo, começamos com \(\phi_{0,0}=0\), \(P_1^0=\gamma(0)\). Então, para \(n=1\) \begin{equation} \phi_{1,1}=\rho(1), \qquad P_2^1=\gamma(0)\big( 1-\phi_{1,1}^2\big)\cdot \end{equation}

Para \(n=2\), \begin{equation} \begin{array}{c} \phi_{2,2} \, = \, \dfrac{\rho(2)-\phi_{1,1}\rho(1)}{1-\phi_{1,1}\rho(1)}, \qquad \phi_{2,1} \, = \, \phi_{1,1} -\phi_{2,2}\phi_{1,1}, \\ P_3^2 \, = \, P_2^1\big(1-\phi_{2,2}^2\big) \, = \, \gamma(0)\big(1-\phi_{1,1}^2\big)\big(1-\phi_{2,2}^2\big)\cdot \end{array} \end{equation}

Para \(n=3\), \begin{equation} \begin{array}{c} \phi_{3,3} \, = \, \dfrac{\rho(3)-\phi_{2,1}\rho(2)-\phi_{2,2}\rho(1)}{1-\phi_{2,1}\rho(1)-\phi_{2,2}\rho(2)}, \qquad \phi_{3,2} \, = \, \phi_{2,2} -\phi_{3,3}\phi_{2,1}, \qquad \phi_{3,1} \, = \, \phi_{2,1}-\phi_{3,3}\phi_{2,2},\\ P_4^3 \, = \, P_3^2\big(1-\phi_{3,3}^2\big) \, = \, \gamma(0)\big(1-\phi_{1,1}^2\big)\big(1-\phi_{2,2}^2\big)\big(1-\phi_{3,3}^2\big) \end{array} \end{equation} e assim por diante. Observe que, em geral, o erro padrão da previsão de um passo à frente é a raiz quadrada de \begin{equation} P_{n+1}^n \, = \, \gamma(0)\prod_{j=1}^n \big( 1-\phi_{j,j}^2\big)\cdot \end{equation}

Uma consequência importante do algoritmo de Durbin-Levinson é o resultado segue.

O PACF de um processo estacionário \(X_t\), pode ser obtido iterativamente via o Teorema III.4 como \(\phi_{n,n}\), para \(n=1,2,\cdots\).

Usando o Teorema III.5 e colocando \(n = p\), segue que para um modelo \(AR(p)\), \begin{equation} \begin{array}{rcl} X_{p+1}^p & = & \phi_{p,1} X_p + \phi_{p,2} X_{p-1}+\cdots+\phi_{p,p}X_ 1\\ & = & \phi_1 X_p + \phi_2 X_{p-1}+\cdots+ \phi_p X_1\cdot \end{array} \end{equation} O resultado acima mostra que, para um modelo \(AR(p)\), o coeficiente de autocorrelação parcial na defasagem \(p\), \(\phi_{p,p}\), também é o último coeficiente no modelo, \(\phi_p\), como foi reivindicado no Exemplo III.16.

Exemplo III.21. O PACF de um modelo \(AR(2)\).

Utilizaremos o resultado do Exemplo III.20 e do Teorema III.5 para calcular os três primeiros valores \(\phi_{1,1}\), \(\phi_{2,2}\) e \(\phi_{3,3}\) do PACF. Lembremos do Exemplo III.10 e \(\rho(h)-\phi_1 \rho(h-1)-\phi_2\rho(h-2)=0\) para \(h\geq 1\). Quando \(h=1,2,3\), temos que \(\rho(1)=\phi_1/(1-\phi_2)\), \(\rho(2)=\phi_1\rho(1)+\phi_2\), \(\rho(3)-\phi_1\rho(2)-\phi_2\rho(1)=0\). Portanto, \begin{equation} \begin{array}{rcl} \phi_{1,1} & = & \rho(1) \, = \, \displaystyle\frac{\phi_1}{1-\phi_2}, \\ \phi_{2,2} & = & \displaystyle\frac{\rho(2)-\rho(1)^2}{1-\rho(1)^2} \, = \, \frac{\displaystyle\left( \phi_1\Big(\frac{\phi_1}{1-\phi_2}\Big)^2+\phi_2\right)-\Big(\frac{\phi_1}{1-\phi_2}\Big)^2}{\displaystyle1-\Big(\frac{\phi_1}{1-\phi_2}\Big)^2} \, = \, \phi_2, \\ \phi_{2,1} & = & \rho(1)\big( 1-\phi_2\big) \, = \, \phi_1, \\ \phi_{3,3} & = & \frac{\displaystyle\rho(3)-\phi_1\rho(2)-\phi_2\rho(1)}{\displaystyle 1-\phi_1\rho(1)-\phi_2\rho(2)} \, = \, 0\cdot \end{array} \end{equation}

Observe que, como mostrado, \(\phi_{2,2} = \phi_2\) para um modelo \(AR(2)\).Até agora, nos concentramos na previsão de um passo à frente, mas o Teorema III.3 nos permite calcular o melhor preditor linear de \(X_{n+m}\) para qualquer \(m\geq 1\). Fornecidos os dados \(\{X_1,\cdots,X_n\}\), o preditor \(m\)-passos-à-frente é \begin{equation} X_{n+m}^n \, = \, \phi_{n,1}^{(m)}X_n + \phi_{n,2}^{(m)}X_n+\cdots+\phi_{n,n}^{(m)}X_1, \end{equation} onde \(\{ \phi_{n,1}^{(m)},\phi_{n,2}^{(m)},\cdots,\cdots,\phi_{n,n}^{(m)}\}\) satisfaz as equações de predição \begin{equation} \sum_{j=1}^n \phi_{n,j}^{(m)} \mbox{E}(X_{n+1-j}X_{n+1-k}) \, =\, \mbox{E}(X_{n+m}X_{n+1-k}), \qquad k=1,\cdots,n, \end{equation} ou \begin{equation} \sum_{j=1}^n \phi_{n,j}^{(m)} \gamma(k-j) \, =\, \gamma(m+k-1), \qquad k=1,\cdots,n\cdot \end{equation}

As equações de predição podem ser novamente escritas em notação matricial como \begin{equation} \Gamma_n\phi_n^{(m)} \, = \, \gamma_n^{(m)}, \end{equation} onde \(\gamma_n^{(m)}=(\gamma(m),\cdots,\gamma(m+n-1))^\top\) e \(\phi_n^{(m)}=(\phi_{n,1}^{(m)},\cdots,\phi_{n,n}^{(m)})^\top\) são vetores \(n\times 1\). O erro médio de predição \(m\) passos à frente é \begin{equation} P_{n+m}^n \, = \, \mbox{E}\big(X_{n+m}-X_{n+m}^n\big)^2 \, = \, \gamma(0)-\gamma_n^{(m)\top} \Gamma_n^{-1}\gamma_n^{(m)}\cdot \end{equation}

Outro algoritmo útil para calcular previsões foi dado por Brockwell e Davis (1991). Esse algoritmo segue diretamente da aplicação do teorema da projeção (Teorema B.1) às inovações, \(X_t-X_t^{t-1}\), para \(t = 1,\cdots,n\), usando o fato de que as inovações\(X_t-X_t^{t-1}\) e \(X_s-X_s^{s-1}\) não são correlacionadas para \(s\neq t\). Apresentamos o caso em que \(X_t\) é uma série temporal estacionária de média zero.

Os preditores de um passo à frente \(X_{t+1}^t\) e seus erros quadráticos médios \(P_{t+1}^t\), podem ser calculados iterativamente como \begin{equation} X_1^0 \, = \, 0, \qquad P_1^0 \, = \, \gamma(0), \end{equation} \begin{equation} X_{t+1}^t \, = \, \sum_{j=1}^t \theta_{t,j}\big( X_{t+1-j}-X_{t+1-j}^{t-j}\big), \qquad t=1,2,\cdots \end{equation} e \begin{equation} P_{t+1}^t \, = \, \gamma(0)-\sum_{j=0}^{t-1} \theta_{t,t-j}^2 P_{j+1}^{j}, \qquad t=1,2,\cdots, \end{equation} onde, para \(j=0,1,\cdots,t-1\), \begin{equation} \theta_{t,t-j} \, = \, \frac{\displaystyle \gamma(t-j)-\sum_{k=0}^{j-1} \theta_{j,j-k}\theta_{t,t-k}P_{k+1}^k}{P_{j+1}^j}\cdot \end{equation}

Dados \(X_1,\cdots,X_n\), o algoritmo de inovações pode ser calculado sucessivamente para \(t = 1\), então \(t = 2\) e assim por diante, caso em que o cálculo de \(X_{n+1}^n\) e \(P_{n+1}^n\) é feito na etapa final \(t = n\). O preditor de \(m\) passos à frente e seu erro quadrático médio baseado no algoritmo de inovações são dados por \begin{equation} X_{n+m}^n \, = \, \sum_{j=m}^{n+m-1} \theta_{n+m-1,j} \big( X_{n+m-j}-X_{n+m-j}^{n+m-j-1}\big) \end{equation} e \begin{equation} P_{n+m}^n \, = \, \gamma(0)-\sum_{j=m}^{n+m-1} \theta_{n+m-1,j}^2 P_{n+m-j}^{n+m-j-1}, \end{equation} onde os \(\theta_{n+m-1,j}\) são obtidos por iteração continuada.

Exemplo III.22. Predição para o \(MA(1)\).

O algoritmo de inovações presta-se bem à previsão de processos médios móveis. Considere um modelo \(MA(1)\), \(X_t=W_t+\theta W_{t-1}\). Lembre-se de que, \(\gamma(0)=(1+\theta^2)\sigma_{_W}^2\), \(\gamma(1)=\theta\sigma_{_W}^2\) e \(\gamma(h)=0\), para \(h\geq 0\). Então, usando a Proposição III.6, temos \begin{equation} \begin{array}{rcl} \theta_{n,1} & = & \displaystyle\frac{\displaystyle\theta\sigma_{_W}^2}{\displaystyle P_{n}^{n-1}}, \\ \theta_{n,j} & = & 0, \qquad j=2,\cdots,n, \\ P_1^0 & = & (1+\theta^2)\sigma_{_W}^2, \\ P_{n+1}^n & = & (1+\theta^2-\theta\theta_{n,1})\sigma_{_W}^2\cdot \end{array} \end{equation}

Finalmente, o preditor um passo à frente é \begin{equation} X_{n+1}^n \, = \, \frac{\displaystyle \theta\big( X_n-X_{n}^{n-1}\big)\sigma_{_W}^2}{\displaystyle P_{n}^{n-1}}\cdot \end{equation}

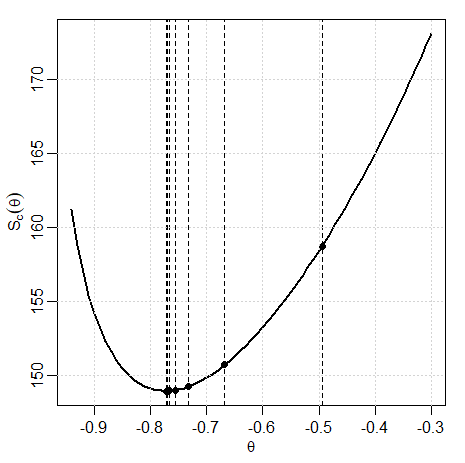

Previsão de processos ARMA

As equações gerais de predição fornecem pouca informação sobre previsão para modelos ARMA em geral. Existem várias maneiras diferentes de expressar essas previsões e cada uma delas ajuda a entender a estrutura especial da predição do ARMA.

Ao longo do tempo, assumimos que \(X_t\) é um processo causal e inversível \(ARMA(p,q)\), \(\phi(B)X_t=\theta(B)W_t\), onde \(W_t\sim N(0,\sigma_{_W}^2)\) independentes. No caso de média não zero \(\mbox{E}(X_t)=\mu_t\), simplesmente substitua \(X_t\) com \(X_t-\mu_t\) no modelo. Primeiro, consideramos dois tipos de previsões. Escrevemos \(X_{n+m}^n\) para significar o preditor de erro quadrático médio mínimo de \(X_{n+m}\) com base nos dados \(\{X_n,\cdots,X_1\}\), isto é, \begin{equation} X_{n+m}^n \, = \, \mbox{E}(X_{n+m}|X_n,\cdots,X_1)\cdot \end{equation}

Para modelos ARMA, é mais fácil calcular o preditor de \(X_{n+m}\) assumindo que temos a história completa do processo \(\{X_n,X_{n-1},\cdots,X_1,X_0,X_{-1},\cdots\}\). Vamos denotar o preditor de \(X_{n+m}\) com base no passado infinito como \begin{equation} \widetilde{X}_{n+m}^n \, = \, \mbox{E}(X_{n+m} \, | \, X_n,X_{n-1},\cdots,X_1,X_0,X_{-1},\cdots)\cdot \end{equation}

Em geral, \(X_{n+m}^n\) e \(\widetilde{X}_{n+m}^n\) não são iguais, mas a ideia aqui é que, para grandes amostras, \(\widetilde{X}_{n+m}^n\) proporcionará uma boa aproximação para \(X_{n+m}^n\).